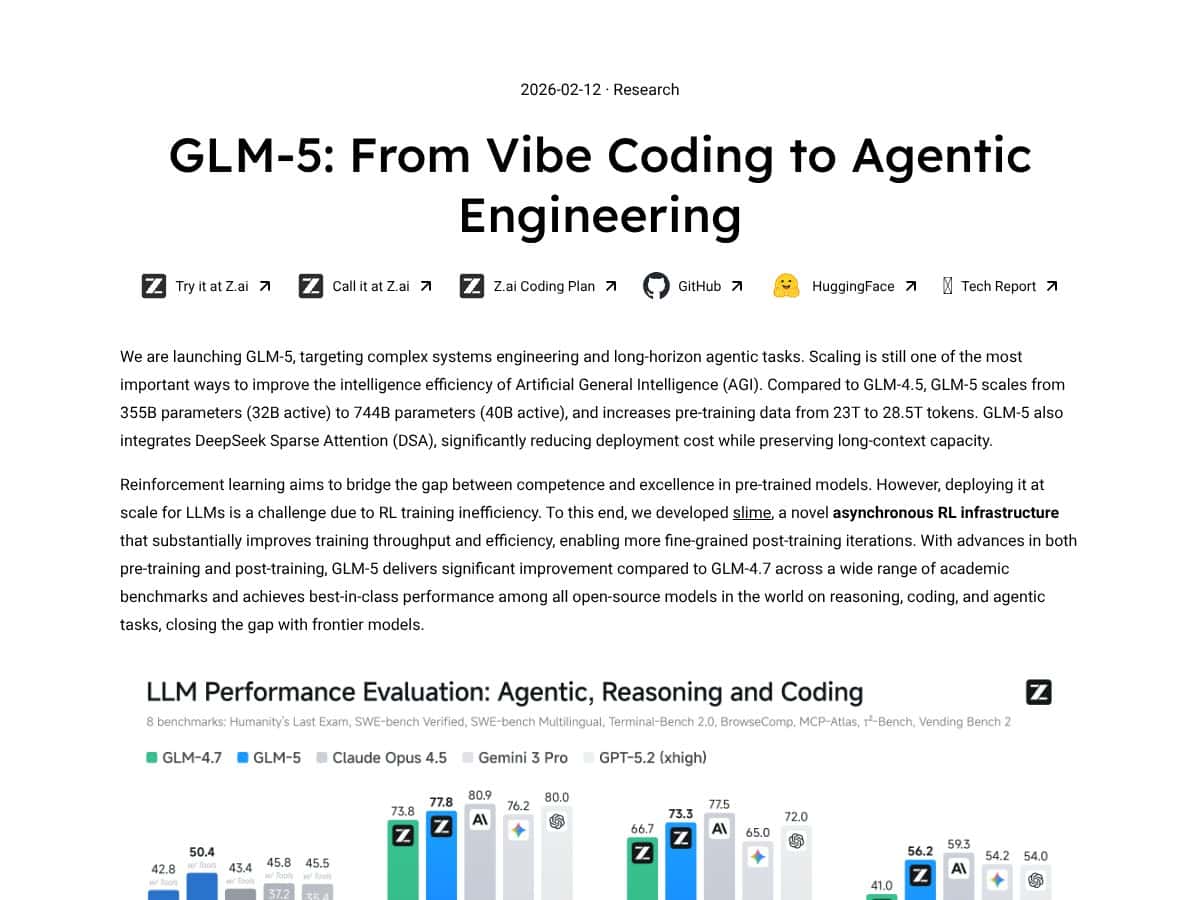

Was ist GLM-5?

Ehrlich gesagt war ich ziemlich skeptisch, als ich zum ersten Mal von GLM-5 hörte. Die KI-Welt ist überschwemmt von Modellen, die behaupten, der nächste große Durchbruch zu sein, und es ist schwer zu sagen, welche wirklich Ihre Zeit oder Ihr Geld wert sind. Doch was meine Aufmerksamkeit erregte, war die Behauptung, dass GLM-5 lange Dokumente, komplexes Denken und sogar agentische Aufgaben bewältigen könne – Dinge, die normalerweise eine Handvoll verschiedener Tools oder schwere proprietäre Modelle erfordern. Also beschloss ich, mich näher damit zu befassen und zu prüfen, ob es dem Hype wirklich standhält.

Auf gut Deutsch: GLM-5 ist ein großes Sprachmodell, das mehr kann als nur chatten; es soll eine ernsthafte Arbeitsmaschine für Aufgaben wie die Analyse langer Berichte, das Schreiben von Code, das Durchdenken komplexer Probleme und sogar das Management von mehrstufigen Arbeitsabläufen sein. Es ist, als würde man ein superskalierendes Gehirn geben, das Hunderte von Seiten Text gleichzeitig fokussieren kann und dann diesen Kontext nutzt, um detaillierte, genaue Antworten zu generieren oder mehrstufige Schlussfolgerungen zu ziehen.

Das Hauptproblem, das es lösen will, ist die Fragmentierung von KI-Tools – die meisten Modelle sind gut in einem oder zwei Bereichen, haben aber Schwierigkeiten mit Langzeitplanung oder dem Umgang mit großen Informationsmengen, ohne sie aufzuteilen. GLM-5 zielt darauf ab, dies zu vereinheitlichen, indem es ein einziges Modell bietet, das extrem lange Kontexte verstehen und daraus Schlussfolgerungen ziehen kann, wodurch es sich für den Unternehmenseinsatz, juristische Analysen, wissenschaftliche Forschung oder sogar komplexe Ingenieursaufgaben eignet.

Die Leute hinter dem Ganzen sind Z.AI, ein chinesisches Unternehmen, das still und heimlich die Grenzen offener Großmodelle verschiebt. Sie haben dieses Modell auf Huawei-Chips aufgebaut – keine NVIDIA-Abhängigkeit –, was aus geopolitischer und Lieferkettenperspektive interessant ist. Mein erster Eindruck? Es entspricht dem, was beworben wird: ein großes, leistungsfähiges Modell, das für ernsthafte, langfristige Aufgaben konzipiert ist. Aber wie immer habe ich meine Erwartungen im Zaum gehalten – das hier ist kein Plug-and-Play-Wunderwerkzeug, und es hat definitiv Einschränkungen.

Was es NICHT ist: Es ist keine glänzende, benutzerfreundliche App, in die man einfach etwas eingeben kann und sofort Ergebnisse erhält. Es gibt kein auffälliges Dashboard, keine integrierte Chat-Oberfläche – zumindest nicht standardmäßig. Es richtet sich hauptsächlich an Entwickler oder Forscher, die sich mit API-Aufrufen auskennen oder Modelle lokal betreiben. Außerdem ist es kein proprietäres geschlossenes System; es ist Open-Source, sodass Sie, falls Sie auf ein poliertes kommerzielles Produkt hoffen, möglicherweise selbst etwas Einrichtung vornehmen müssen.

GLM-5 Preisgestaltung: Lohnt es sich?

Hier ist das Ding bei der Preisgestaltung: Die Kosten von GLM-5 sind ziemlich transparent, wenn Sie über Z.AI oder Drittanbieter-API-Anbieter darauf zugreifen, aber der tatsächliche Wert hängt stark von Ihrem Anwendungsfall und Budget ab. Lassen Sie uns aufschlüsseln, was verfügbar ist, und prüfen, ob es ein faires Angebot ist.

| Plan | Preis | Was Sie erhalten | Meine Einschätzung |

|---|---|---|---|

| Direct API (Z.ai) | $1,00 pro 1 Mio Eingabe-Tokens, $3,20 pro 1 Mio Ausgabe-Tokens | Zugriff auf GLM-5-Modelle, mit langem Kontext (bis zu 203.000 Tokens), strukturierte Ausgabe, Tool-Integration | Preislich fair für intensive Nutzer, insbesondere wenn Ihre Arbeit lange Dokumente oder komplexe Schlussfolgerungen umfasst. Achten Sie auf Kosten, falls Ihr Output-Volumen hoch ist, da Output-Tokens teurer sind. |

| Cached input tokens | $0,20 pro 1 Mio Tokens | Zwischengespeicherte Eingabe-Tokens, nützlich für Kosteneinsparungen bei statischen Datensätzen | Günstiger für wiederholte oder zwischengespeicherte Eingaben, nützlich zur Kosteneinsparung bei statischen Datensätzen |

| Drittanbieter (z. B. DeepInfra, Fireworks) | Beginnend bei ca. $1,24 pro 1 Mio Tokens (Durchschnittspreis) | Wettbewerbsfähige Preise, oft mit zusätzlichen Funktionen oder Integrationen | Preisgestaltung variiert, also Angebote vergleichen. Allerdings neigen sie dazu, etwas teurer zu sein als direkte API, wenn Sie hohen Durchsatz benötigen. |

| Selbst gehostete Open-Weights (HuggingFace, ModelScope) | Kostenlos (MIT-Lizenz), aber Hardware- und Betriebskosten fallen an | Vollständige Kontrolle über Bereitstellung, Datenschutz, keine laufenden API-Kosten | Ideal für Organisationen mit technischer Kapazität und Datenschutzbedürfnissen, aber beachten Sie Infrastrukturkosten und Wartung. |

Und hier ist das große Ganze: Ist es das Wert? Das hängt davon ab. Für einzelne Entwickler oder Teams, die extrem lange Kontextfenster und fortgeschrittene Schlussfolgerungen benötigen, können die Kosten gerechtfertigt sein — insbesondere, wenn Sie selbst hosten und Anbieterbindung vermeiden. Für Gelegenheitsnutzer oder kleine Projekte können die Kosten schnell steigen, insbesondere bei hohem Bedarf an Ausgabe-Tokens.

Kleiner Hinweis: Die Preisgestaltung ist nicht unbedingt günstig, insbesondere im Vergleich zu chinesischen Open-Source-Modellen wie Qwen oder DeepSeek, die um das Drei- bis Fünffache günstiger sind. Aber sie gehen oft mit Abstrichen in Leistung, Support oder Funktionen einher. Wenn Sie erstklassige Schlussfolgerungen und Langzeit-Kontext-Fähigkeiten benötigen, könnte der Premium-Preis gerechtfertigt sein. Wenn Sie budgetbewusst sind oder das volle 203.000 Token-Fenster nicht benötigen, gibt es günstigere Optionen, die die Arbeit dennoch erledigen.

Zusammenfassend lässt sich sagen, dass die Preisgestaltung Sinn ergibt für Unternehmenskunden oder Forscher mit ernsthaften Arbeitslasten. Für Hobbyisten oder kleine Teams prüfen Sie, ob der Langkontext und die fortschrittlichen Funktionen den Aufpreis wert sind oder ob ein kostengünstigeres chinesisches Modell besser zu Ihren Bedürfnissen passt.

Das Gute und das Schlechte

Was mir gefallen hat

- Enormes Kontextfenster: Mit bis zu 203.000 Tokens kann GLM-5 gesamte Berichte, lange Rechtsdokumente oder mehrteilige Gespräche analysieren, ohne den Kontext zu verlieren. Das ist ein Wendepunkt für datenintensive Aufgaben.

Was könnte besser sein

- Begrenzte öffentlich zugängliche Benchmark-Daten: Im Vergleich zu Modellen wie GPT-5 oder Claude sind die Leistungskennzahlen von GLM-5 außerhalb akademischer Benchmarks nicht so breit dokumentiert, was es schwieriger macht, reale Leistung einzuschätzen.

- Hauptsächlich auf chinesische Kontexte ausgerichtet: Obwohl es Englisch unterstützt, könnte der Training-Fokus auf chinesischen Daten zu weniger nuanciertem Verständnis oder geringerer Leistung in spezialisierten westlichen Anwendungsfällen führen.

- Preiskomplexität: Die gestaffelte und anbieterabhängige Preisgestaltung kann verwirrend sein, insbesondere für kleinere Teams, die Kosten vorhersagen möchten. Nutzungsobergrenzen oder Funktionsgrenzen werden nicht deutlich im Voraus angekündigt.

- Begrenzte Einsatzhistorie: Da es ein neues Modell ist, verfügt es noch nicht über dieselbe Bereitstellungsgeschichte oder Community-Unterstützung wie etablierte Giganten, was Unternehmenskäufern Bedenken bereiten könnte.

- Ausgabe-Token-Kosten: Ausgabe-Tokens sind relativ teuer, was hochvolumige oder interaktive Anwendungen mit der Zeit teuer machen könnte.

Für wen ist GLM-5 eigentlich gedacht?

Wenn Sie Forscher oder Entwickler sind, die an Projekten arbeiten, die lange Dokumente verarbeiten, komplexe Schlussfolgerungen ziehen oder mehrstufige Planung erfordern, kann GLM-5 eine solide Wahl sein. Es ist besonders attraktiv, wenn Sie Open-Source-Modelle bevorzugen, die Sie selbst hosten können, oder Vendor-Lock-in vermeiden möchten. Stellen Sie es sich als eine leistungsstarke, anpassbare Engine für wissensintensive Arbeitsabläufe vor – wie Rechtsanalyse, wissenschaftliche Forschung oder fortgeschrittene Codierungsaufgaben.

Datenwissenschaftler, die große Datensätze verwalten, oder Rechtsabteilungen, die lange Verträge analysieren, werden das umfangreiche Kontextfenster als unschätzbar wertvoll empfinden. Ebenso könnten KI-Entwickler, die agentische Systeme oder multimodale Arbeitsabläufe aufbauen, von seinen strukturierten Ausgaben und den Funktionen zur Tool-Integration profitieren, um Abläufe zu optimieren.

Im Wesentlichen gilt: Wenn Ihre Arbeit ein tiefes Verständnis längerer Inhalte, langfristige Planung oder komplexes Denken erfordert, ist GLM-5 für Sie konzipiert. Es ist nicht unbedingt die beste Wahl für lockere oder leichte Aufgaben, bei denen ein kleineres oder günstigeres Modell ausreichen könnte.

Wer sich woanders umsehen sollte

Wenn Ihre Bedürfnisse grundlegend sind — zum Beispiel Kundensupport-Chatbots, einfache Inhaltserstellung oder eine unkomplizierte Zusammenfassung — könnte GLM-5 überdimensioniert sein. Sein umfangreiches Kontextfenster und fortgeschrittene Funktionen würden nicht vollständig genutzt werden, und günstigere Modelle (wie GPT-3.5 oder kleinere chinesische Modelle) könnten die Aufgabe kosteneffizienter erledigen.

Für Organisationen, die stark auf bewährte, weithin eingesetzte Modelle mit umfangreicher Community-Unterstützung angewiesen sind, könnten GPT-4 oder GPT-5 vorzuziehen sein. Ebenso, wenn Ihre Priorität Zuverlässigkeit auf Unternehmensebene, Support und eine nachweisliche Bereitstellung ist, besitzt der neuere GLM-5 möglicherweise noch nicht die erforderliche Erfolgsbilanz.

Und wenn Ihre Hauptsorge die Erschwinglichkeit ist — insbesondere für Kleinprojekte oder Hobbyprojekte — Modelle wie Qwen, DeepSeek oder sogar Open-Source-Alternativen auf Hugging Face könnten besser zu Ihren Budgetrestriktionen passen, während sie dennoch eine anständige Leistung bieten.

Wie GLM-5 im Vergleich zu Alternativen abschneidet

Claude Opus 4.5/4.6

- Claude Opus ist ein Premium-Modell aus dem Westen, bekannt für seine starken Schlussfolgerungsfähigkeiten und Sicherheitsmerkmale. Es ist optimiert für nuancierte Gespräche, ethische Überlegungen und den Unternehmenseinsatz, und übertrifft oft offene Modelle in kritischen Denkaufgaben. Allerdings ist es mit deutlich höheren Kosten verbunden, wodurch es für budgetbewusste Nutzer weniger zugänglich ist.

- Preislich kostet Claude Opus 4.5/4.6 typischerweise mehrere Male mehr als GLM-5 — grob etwa das Fünffache oder mehr, abhängig von Nutzung und Lizenzierung.

- Wählen Sie dies, wenn Sie erstklassige Sicherheit, nuanciertes Verständnis benötigen und bereit sind, dafür eine Prämie zu zahlen. Es eignet sich ideal für Anwendungen auf Unternehmensebene, die hohe Zuverlässigkeit erfordern.

- Bleiben Sie bei GLM-5, wenn Sie nach einem hochleistungsfähigen offenen Modell mit Langzeit-Kontextunterstützung suchen und Geld sparen möchten — insbesondere, wenn Sie damit ein Modell bevorzugen, das stärker auf Chinesisch optimiert ist, aber auch im Englischen leistungsstark bleibt.

GPT-5.2 (OpenAI)

- GPT-5.2 ist das neueste proprietäre Kraftpaket, bekannt für seine breite Vielseitigkeit und herausragende Leistung in vielen Bereichen, einschließlich kreativem Schreiben, Codierung und Schlussfolgerungen. Es profitiert von umfangreichen Trainingsdaten und regelmäßigen Updates und behält in vielen Benchmarks die Spitzenposition.

- Die Preisgestaltung für GPT-5.2 liegt in der Regel höher, oft rund 4,00 USD pro 1.000 Token, was es pro Nutzung teurer macht als GLM-5, das 1,00 USD pro Million Eingabe-Token kostet.

- Wählen Sie GPT-5.2, wenn Sie die absolute beste Leistung benötigen, insbesondere bei zukunftsweisenden Aufgaben, oder auf eine Plattform angewiesen sind, die eng in das OpenAI-Ökosystem integriert ist.

DeepSeek

- DeepSeek ist ein chinesisches offenes Modell, das deutlich günstiger ist—etwa 3–5-mal günstiger als GLM-5—und sich auf die chinesische Sprache und den lokalen Kontext konzentriert. Es ist für chinesische NLP-Aufgaben optimiert und weniger für Englisch oder mehrsprachige Arbeitsabläufe.

- Preislich liegt es grob bei 0,25–0,50 USD pro 1.000 Tokens, was es sehr attraktiv macht für chinesischsprachige Anwendungen mit hohem Volumen.

- Wählen Sie dies, wenn Ihre primäre Arbeit auf Chinesisch erfolgt und Sie ein kosteneffizientes, offenes Modell mit ordentlichen Schlussfolgerungsfähigkeiten benötigen.

- Bleiben Sie bei GLM-5, wenn Sie bessere Englischunterstützung oder eine längere Kontextverarbeitung für komplexe, mehrsprachige Arbeitsabläufe benötigen.

Qwen (Alibaba)

- Qwen ist ein weiteres chinesisches offenes Modell, das gute Leistung zu geringeren Kosten bietet und oft direkt mit DeepSeek konkurriert. Es ist darauf ausgelegt, chinesische Unternehmensbedürfnisse zu bedienen, mit Fokus auf Kosteneffizienz und lokale Compliance.

- Die Preisgestaltung variiert, liegt aber tendenziell unter GLM-5, etwa 1 USD pro Million Token, was es für groß angelegte chinesische NLP-Projekte geeignet macht.

- Wählen Sie Qwen, wenn chinesische Sprachunterstützung und Erschwinglichkeit Ihre wichtigsten Prioritäten sind und Sie mit weniger umfangreichen Langzeit-Kontextfähigkeiten einverstanden sind.

- Bleiben Sie bei GLM-5, wenn Sie umfassendes Schlussfolgern, Codierung oder lange Dokumentenanalyse in Englisch oder mehrsprachigen Kontexten benötigen.

GigaChat-2-Max (Sber)

- GigaChat-2-Max ist ein russisch entwickeltes Modell mit Fokus auf lokale Sprache und Kontext und bietet eine ordentliche mehrsprachige Unterstützung. Es ist eine gute Wahl für regionale Projekte und das Verständnis lokaler Nuancen.

- Die Preisgestaltung ist in der Regel wettbewerbsfähig und liegt meist im Bereich anderer regionaler Open-Modelle; Details hängen jedoch vom Anbieter ab.

- Wählen Sie dies, wenn Sie hauptsächlich auf Russisch oder regionale Sprachen arbeiten und eine offene, selbst-hostbare Lösung benötigen.

- Bleiben Sie bei GLM-5, wenn globales, mehrsprachiges Schlussfolgern, Langkontext und fortgeschrittene Codierung Priorität haben, oder wenn Sie ein Modell mit einem breiteren internationalen Fokus bevorzugen.

Fazit: Sollten Sie GLM-5 ausprobieren?

Insgesamt würde ich GLM-5 etwa 7,5/10 bewerten. Es ist ein leistungsstarkes, vielseitiges Modell, das außergewöhnlichen Wert bietet—insbesondere dank seines langen Kontextfensters und der Verfügbarkeit offener Gewichte. Die Leistung liegt beeindruckend nah an führenden westlichen Modellen wie Claude Opus und GPT-5.2, aber es ist nicht ganz der absolute Spitzenreiter in jedem Nischenbereich. Das gesagt, ist es eine solide Wahl, wenn Sie eine flexible, kosteneffiziente und datenschutzbewusste Option wünschen.

Wenn Sie regelmäßig mit umfangreichen Dokumenten arbeiten, komplexe Schlussfolgerungen ziehen oder ein Modell benötigen, das Sie selbst hosten können, ohne Anbietersperre, ist GLM-5 definitiv einen Versuch wert. Die offene Lizenz und die Langzeit-Kontextunterstützung machen es attraktiv für experimentelle Projekte und Unternehmensworkflows.

Auf der anderen Seite, wenn Sie erstklassige Leistung bei den neuesten proprietären Benchmarks benötigen oder stark auf englischsprachige Arbeitsabläufe mit wenig Anpassungsmöglichkeiten setzen, könnten Sie GPT-5 bevorzugen. Es ist teurer, aber der Leistungsvorteil ist deutlich spürbar.

Persönlich würde ich sagen, dass die kostenlose Stufe es wert ist, ausprobiert zu werden, wenn Sie gerade erst anfangen—insbesondere um die Langdokumentenanalyse zu testen. Die kostenpflichtige Version lohnt sich, wenn Sie ernsthaft daran interessiert sind, sie in der Produktion einzusetzen, oder die erweiterte Kontextlänge und fortgeschrittene Funktionen nutzen möchten. Wenn Ihre Bedürfnisse nischenhaft oder stark sprachspezifisch sind, ziehen Sie die von mir erwähnten Alternativen in Betracht.

Wenn Ihre Priorität eine kosteneffiziente, offene und leistungsfähige KI für Aufgaben mit langfristiger Perspektive ist, probieren Sie GLM-5 aus. Wenn Sie die absolute Spitzenleistung bei minimalem Aufwand suchen, sollten Sie sich woanders umsehen.

Häufig gestellte Fragen zu GLM-5

- Reicht GLM-5 das Geld wert? – Ja, wenn Sie ein leistungsfähiges Modell mit großem Kontextfenster und offener Lizenzierung benötigen. Es bietet ein starkes Preis-Leistungs-Verhältnis, auch wenn es in einigen Benchmarks möglicherweise nicht ganz mit den neuesten proprietären Modellen mithalten kann.

- Gibt es eine kostenlose Version? – Es gibt eine Open-Weight-Version auf HuggingFace, die kostenlos für Forschung und Experimente genutzt werden kann, aber sie erfordert Selbst-Hosting und hat einige Leistungsbeschränkungen im Vergleich zum kostenpflichtigen API-Zugang.

- Wie schneidet es im Vergleich zu GPT-5.2 ab? – GPT-5.2 schneidet in der Regel besser ab als GLM-5 in der rohen Leistung und bei den neuesten Benchmarks, ist jedoch teurer und weniger flexibel, wenn Sie offene Modelle und Self-Hosting bevorzugen.

- Kann es mehrsprachige Aufgaben bewältigen? – Ja, es unterstützt Englisch gut und ist für Chinesisch optimiert. Seine Mehrsprachenleistung ist gut, aber etwas weniger fein als Modelle, die speziell für mehrsprachige Nutzung abgestimmt sind.

- Wie lang ist der maximale Kontext? – Bis zu ungefähr 203.000 Tokens, was ideal ist für die Analyse langer Dokumente, Berichte oder mehrstufige Denkaufgaben.

- Kann ich eine Rückerstattung erhalten? – Die Rückerstattungsbedingungen hängen vom API-Anbieter ab, den Sie wählen. In der Regel bieten kostenpflichtige Pläne einige Rückerstattungsoptionen, aber prüfen Sie die konkreten Bedingungen des Anbieters.