¿Qué es GLM-5?

Sinceramente, estaba bastante escéptico cuando escuché por primera vez sobre GLM-5. El mundo de la IA está inundado de modelos que dicen ser lo próximo gran avance, y es difícil saber cuáles valen tu tiempo o dinero. Pero lo que captó mi atención fue la afirmación de que GLM-5 podría manejar documentos extensos, razonamiento complejo e incluso tareas con capacidad de actuar por cuenta propia—algo que normalmente requiere un puñado de herramientas diferentes o modelos propietarios pesados. Así que decidí investigar a fondo para ver si realmente está a la altura de las expectativas.

En lenguaje llano, GLM-5 es un gran modelo de lenguaje diseñado para hacer más que conversar; pretende ser una pieza clave para tareas como analizar informes extensos, escribir código, razonar ante problemas complejos y gestionar flujos de trabajo de múltiples pasos. Es como darle un cerebro supercargado que puede mantener cientos de páginas de texto en foco al mismo tiempo, y usar ese contexto para generar respuestas detalladas y precisas o realizar razonamiento de múltiples capas.

El problema principal que intenta resolver es la fragmentación de las herramientas de IA: la mayoría de los modelos son buenos en una o dos cosas, pero les cuesta la planificación a largo plazo o manejar grandes bloques de información sin cortarlos. GLM-5 busca unificar esto al ofrecer un único modelo capaz de entender y razonar sobre contextos extremadamente largos, lo que lo hace adecuado para uso empresarial, análisis legal, investigación científica o incluso tareas de ingeniería complejas.

La gente detrás de esto es Z.AI, una empresa china que ha estado empujando discretamente los límites de los grandes modelos de código abierto. Lo han construido sobre chips de Huawei, sin dependencia de NVIDIA, lo cual es interesante desde una perspectiva geopolítica y de la cadena de suministro. ¿Mi impresión inicial? Es tal como se anuncia: un modelo grande y capaz, diseñado para tareas serias y de largo alcance. Pero, como siempre, mantuve mis expectativas bajo control: no es una varita mágica lista para enchufar y usar, y definitivamente tiene limitaciones.

Lo que NO es: no es una aplicación brillante y fácil de usar a la que solo puedas escribir y obtener resultados instantáneos. No hay un panel llamativo, ni una interfaz de chat integrada, al menos no lista para usar de fábrica. Se dirige principalmente a desarrolladores o investigadores que se sienten cómodos trabajando con llamadas a API o ejecutando modelos localmente. Además, no es un sistema cerrado y propietario; es código abierto, así que si esperas un producto comercial pulido, es posible que debas hacer algo de configuración por tu cuenta.

¿Precios de GLM-5: vale la pena?

Aquí está lo fundamental sobre los precios: los costos de GLM-5 son bastante transparentes si lo accedes a través de Z.AI o proveedores de API de terceros, pero el valor real depende en gran medida de tu caso de uso y presupuesto. Analicemos lo que está disponible y comprobemos si es una oferta justa.

| Plan | Precio | Qué obtienes | Mi opinión |

|---|---|---|---|

| API Directa (Z.ai) | $1,00 por 1M tokens de entrada, $3,20 por 1M tokens de salida | Acceso a modelos GLM-5, capaces de manejo de contexto largo (hasta 203K tokens), salida estructurada, integración de herramientas | Precio razonable para usuarios intensivos, especialmente si tu carga de trabajo implica documentos largos o razonamiento complejo. Ten en cuenta los costos si tu volumen de salida es alto, ya que los tokens de salida son más costosos. |

| Tokens de entrada en caché | $0,20 por 1M tokens | Más económicos para entradas repetidas o en caché, útiles para ahorrar costos en conjuntos de datos estáticos | Bueno para investigación o tareas repetitivas, pero limitado si necesitas interacción en tiempo real. |

| Proveedores de terceros (p. ej., DeepInfra, Fireworks) | A partir de alrededor de $1,24 por 1M tokens (tasa combinada) | Tarifas competitivas, a menudo con características o integraciones adicionales | Los precios varían, así que compara. Sin embargo, tienden a ser ligeramente más caros que la API directa si necesitas un alto rendimiento. |

| Pesos abiertos autoalojados (HuggingFace, ModelScope) | Gratis (Licencia MIT), pero aplican costos de hardware y operación | Control total sobre el despliegue, privacidad de datos, sin costos continuos de API | Ideal para organizaciones con capacidad técnica y necesidades de privacidad, pero ojo con los costos de infraestructura y el mantenimiento. |

Y, en resumen, aquí está la visión general: ¿Vale la pena? Eso depende. Para desarrolladores individuales o equipos que necesitan ventanas de contexto extremadamente largas y razonamiento avanzado, el costo puede justificarse, especialmente si lo gestionas en tu propio entorno y evitas el bloqueo de proveedores. Para usuarios casuales o proyectos pequeños, los costos pueden acumularse rápidamente, especialmente con altas demandas de tokens de salida.

Advertencia: Los precios no son necesariamente económicos, especialmente en comparación con modelos abiertos chinos como Qwen o DeepSeek, que cuestan de 3 a 5 veces menos. Pero esos a menudo traen consigo compromisos en rendimiento, soporte o características. Por lo tanto, si necesitas razonamiento de alto nivel y capacidad de contexto largo, el precio premium podría justificarse. Si tu presupuesto es estrecho o no necesitas la ventana completa de 203K tokens, hay opciones más baratas que aún así hacen el trabajo.

En resumen, diría que la estructura de precios tiene sentido para usuarios empresariales o investigadores con cargas de trabajo serias. Para aficionados o equipos pequeños, considera si el contexto largo y las funciones avanzadas valen el precio premium o si un modelo chino más económico se ajusta mejor a tus necesidades.

Lo Bueno y Lo Malo

Lo Que Me Gustó

- Ventana de Contexto Enorme: Con hasta 203K tokens, GLM-5 puede analizar informes completos, documentos legales extensos o conversaciones en varias partes sin perder el contexto. Eso representa un gran avance para tareas con alto volumen de datos.

Qué podría mejorar

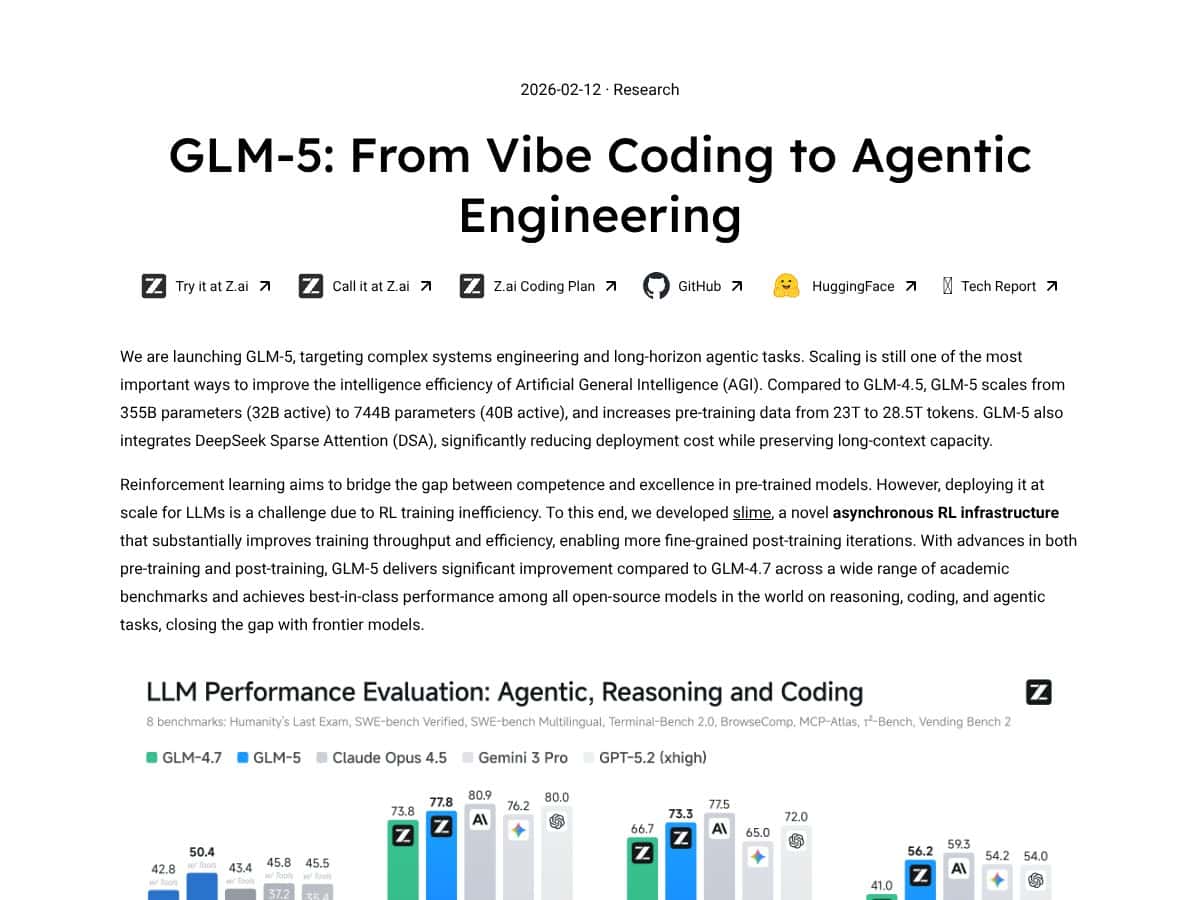

- Datos de benchmarks públicos limitados: En comparación con modelos como GPT-5 o Claude, las métricas de rendimiento de GLM-5 no están tan ampliamente documentadas fuera de benchmarks académicos, lo que dificulta evaluar el rendimiento en escenarios reales.

- Principalmente optimizado para contextos chinos: Aunque admite inglés, su enfoque de entrenamiento en datos chinos puede conducir a una comprensión menos matizada o un rendimiento inferior en casos de uso occidentales más específicos.

- Complejidad de precios: Los precios escalonados y dependientes del proveedor pueden resultar confusos, especialmente para equipos pequeños que intentan prever los costos. Los límites de uso o las restricciones por características no están claramente anunciados de antemano.

- Historial de despliegue limitado: Al ser un modelo nuevo, aún no cuenta con el mismo historial de despliegue o el apoyo de la comunidad que los gigantes consolidados, lo que podría preocupar a compradores empresariales.

- Costo por token de salida: Los tokens de salida son relativamente caros, lo que podría encarecer aplicaciones de alto volumen o interactivas con el tiempo.

¿Para quién es realmente GLM-5?

Si eres un investigador o desarrollador que trabaja en proyectos que requieren procesar documentos largos, razonamiento complejo o planificación en múltiples pasos, GLM-5 puede ser una opción sólida. Es especialmente atractiva si prefieres modelos de código abierto que puedas autoalojar o quieres evitar el bloqueo de proveedores. Piensa en ello como un motor poderoso y personalizable para flujos de trabajo que requieren conocimiento, como análisis legal, investigación científica o tareas avanzadas de programación.

Los científicos de datos que gestionan grandes conjuntos de datos o los equipos legales que analizan contratos extensos encontrarán invaluable su amplia ventana de contexto. Del mismo modo, los desarrolladores de IA que crean sistemas basados en agentes o flujos de trabajo multimodales podrían aprovechar su salida estructurada y las funciones de integración de herramientas para optimizar las operaciones.

En esencia, si su trabajo exige una comprensión profunda de contenidos extensos, una planificación a largo plazo o un razonamiento complejo, GLM-5 está diseñado pensando en usted. No es necesariamente la mejor opción para tareas casuales o ligeras, donde un modelo más pequeño o más económico podría bastar.

Quién debería buscar en otro lugar

Si sus necesidades son básicas — por ejemplo, chatbots de soporte al cliente, generación de contenido simple o resúmenes directos — GLM-5 podría ser un exceso. Su ventana de contexto largo y características avanzadas no se aprovecharán por completo, y modelos más baratos (como GPT-3.5 o modelos chinos más pequeños) podrían hacer el trabajo de forma más rentable.

Para las organizaciones que dependen en gran medida de modelos probados, ampliamente implementados y con un amplio soporte de la comunidad, GPT-4 o GPT-5 podrían ser preferibles. De igual manera, si su prioridad es fiabilidad, soporte y despliegue probados a nivel empresarial, el GLM-5 más reciente quizá aún no tenga el historial que necesita.

Y si su principal preocupación es la asequibilidad — especialmente para proyectos a pequeña escala o de hobby — modelos como Qwen, DeepSeek, o incluso alternativas de código abierto en Hugging Face podrían ajustarse mejor a sus restricciones presupuestarias, al tiempo que ofrecen un rendimiento decente.

Cómo se compara GLM-5 con las alternativas

Claude Opus 4.5/4.6

- Claude Opus es un modelo occidental premium conocido por su razonamiento sólido y características de seguridad. Está optimizado para conversaciones matizadas, consideraciones éticas y uso empresarial, y a menudo supera a los modelos abiertos en tareas de razonamiento crítico. Sin embargo, tiene un costo significativamente más alto, lo que lo hace menos accesible para usuarios con presupuesto ajustado.

- En cuanto al precio, Claude Opus 4.5/4.6 suele costar varias veces más que GLM-5 — aproximadamente 5x o más, dependiendo del uso y la licencia.

- Opte por esto si necesita seguridad de primer nivel, comprensión matizada y está dispuesto a pagar una prima por ello. Es ideal para aplicaciones de nivel empresarial que requieren alta fiabilidad.

- Manténgase con GLM-5 si está buscando un modelo abierto altamente capaz con soporte de contexto largo y quiere ahorrar dinero, especialmente si le resulta aceptable un modelo optimizado más para el idioma chino pero que siga siendo fuerte en inglés.

GPT-5.2 (OpenAI)

- GPT-5.2 es la última potencia propietaria conocida por su amplia versatilidad y rendimiento de primera clase en muchos dominios, incluyendo escritura creativa, codificación y razonamiento. Se beneficia de datos de entrenamiento extensos y actualizaciones frecuentes, manteniendo una ventaja en numerosos puntos de referencia.

- El precio de GPT-5.2 suele ser más alto, generalmente alrededor de 4,00 USD por cada 1.000 tokens, lo que lo encarece por uso en comparación con los 1,00 USD por millón de tokens de entrada de GLM-5.

- Elija GPT-5.2 si necesita el máximo rendimiento, especialmente en tareas de vanguardia, o si depende de una plataforma con una integración estrecha al ecosistema de OpenAI.

DeepSeek

- DeepSeek es un modelo abierto chino que es significativamente más barato, aproximadamente 3-5 veces menos costoso que GLM-5, y se centra en el idioma chino y el contexto local. Está optimizado para tareas de PLN en chino y menos para el inglés o flujos de trabajo multilingües.

- El precio es aproximadamente de 0,25–0,50 USD por cada 1.000 tokens, lo que lo hace muy atractivo para aplicaciones de alto volumen en chino.

- Elige esto si tu trabajo principal es en chino y necesitas un modelo rentable y abierto con capacidades de razonamiento decentes.

- Mantente con GLM-5 si necesitas mejor soporte en inglés o un manejo de contexto más amplio para flujos de trabajo complejos y multilingües.

Qwen (Alibaba)

- Qwen es otro modelo abierto chino que ofrece un buen rendimiento a un costo menor, a menudo compitiendo directamente con DeepSeek. Está diseñado para servir a las necesidades empresariales chinas con un enfoque en la eficiencia de costos y el cumplimiento local.

- Los precios varían pero tienden a ser menores que GLM-5, alrededor de 1 USD por cada millón de tokens, lo que lo hace adecuado para proyectos de PLN en chino a gran escala.

- Elige Qwen si el soporte del chino y la asequibilidad son tus prioridades principales, y estás de acuerdo con menos capacidades de contexto de largo alcance.

- Mantente con GLM-5 si necesitas razonamiento extenso, codificación o análisis de documentos largos en inglés o contextos multilingües.

GigaChat-2-Max (Sber)

- GigaChat-2-Max es un modelo desarrollado en Rusia con un enfoque en el idioma local y el contexto, ofreciendo un soporte multilingüe decente. Es una buena opción para proyectos regionales y para comprender las sutilezas locales.

- Los precios suelen ser competitivos, similares a los de otros modelos abiertos regionales, pero los detalles dependen del proveedor.

- Elige esto si trabajas principalmente en ruso o en idiomas regionales y necesitas una solución abierta y autoalojable.

- Mantente con GLM-5 si el razonamiento global y multilingüe, el contexto largo y la codificación avanzada son prioridades, o si prefieres un modelo con un alcance internacional más amplio.

Conclusión: ¿Deberías probar GLM-5?

En general, calificaría GLM-5 alrededor de 7,5/10. Es un modelo poderoso y versátil que ofrece un valor excepcional, especialmente por su ventana de contexto larga y la disponibilidad de pesos abiertos. El rendimiento está sorprendentemente cercano a los mejores modelos occidentales como Claude Opus y GPT-5.2, pero no es exactamente el líder absoluto en todos los nichos. Dicho esto, es una opción sólida si buscas una opción flexible, rentable y consciente de la privacidad.

Si trabajas con documentos extensos, razonamiento complejo o necesitas un modelo que puedas autoalojar sin depender de un proveedor, GLM-5 sin duda vale la pena probarlo. La licencia abierta y el soporte de contexto largo lo hacen atractivo para proyectos experimentales y flujos de trabajo empresariales.

Por otro lado, si necesitas rendimiento de última generación en las pruebas de referencia propietarias más recientes o dependes en gran medida de flujos de trabajo exclusivamente en inglés con personalización mínima, podrías preferir GPT-5. Es más caro, pero la ventaja de rendimiento es notable.

Personalmente, diría que la capa gratuita vale la pena probarla si acabas de empezar—especialmente para probar su análisis de documentos largos. La versión de pago vale la pena actualizarla si te tomas en serio desplegarla en producción o quieres aprovechar el contexto extendido y las funciones avanzadas. Si tus necesidades son de nicho o fuertemente específicas de un idioma, considera las alternativas que mencioné.

Si tu prioridad es una IA rentable, abierta y capaz para tareas de largo alcance, prueba GLM-5. Si buscas el rendimiento absoluto más alto con el mínimo esfuerzo, quizá quieras mirar en otro lugar.

Preguntas frecuentes sobre GLM-5

- ¿Vale GLM-5 lo que cuesta? - Sí, si necesitas un modelo capaz con una ventana de contexto enorme y licencia abierta. Es una opción de gran valor, aunque puede quedar por detrás de los últimos modelos propietarios en algunas pruebas de rendimiento.

- ¿Existe una versión gratuita? - Hay una versión con pesos abiertos disponible en HuggingFace, que es gratuita para investigación y experimentación, pero requiere autoalojamiento y tiene algunas limitaciones de rendimiento en comparación con el acceso API de pago.

- ¿Cómo se compara con GPT-5.2? - GPT-5.2, en general, supera a GLM-5 en rendimiento bruto y en las pruebas de rendimiento más recientes, pero es más caro y menos flexible si prefieres modelos abiertos y autoalojamiento.

- ¿Puede manejar tareas multilingües? - Sí, admite bien el inglés y está optimizado para el chino. Su rendimiento multilingüe es bueno, pero ligeramente menos refinado que los modelos específicamente ajustados para uso multilingüe.

- ¿Cuál es la longitud máxima de contexto? - Hasta aproximadamente 203,000 tokens, lo que es ideal para analizar documentos extensos, informes o tareas de razonamiento de varios pasos.

- ¿Puedo obtener un reembolso? - Las políticas de reembolso dependen del proveedor de API que elijas. Por lo general, los planes de pago pueden ofrecer algunas opciones de reembolso, pero verifica los términos específicos del proveedor.