¿Qué es Next.js Evals?

Honestamente, cuando supe por primera vez de Next.js Evals, me pregunté qué estaba tratando de hacer exactamente. Quiero decir, he visto un montón de herramientas de evaluación de IA antes, pero esta afirma evaluar qué tan bien se desempeñan los agentes de IA en tareas específicas de Next.js, como la generación de código y la migración. Eso me dejó intriga de inmediato: ¿realmente estamos en un punto en el que podemos medir de forma fiable la capacidad de la IA para manejar un framework tan popular como Next.js? ¿O es solo otra estadística que suena bien pero no cuenta toda la historia?

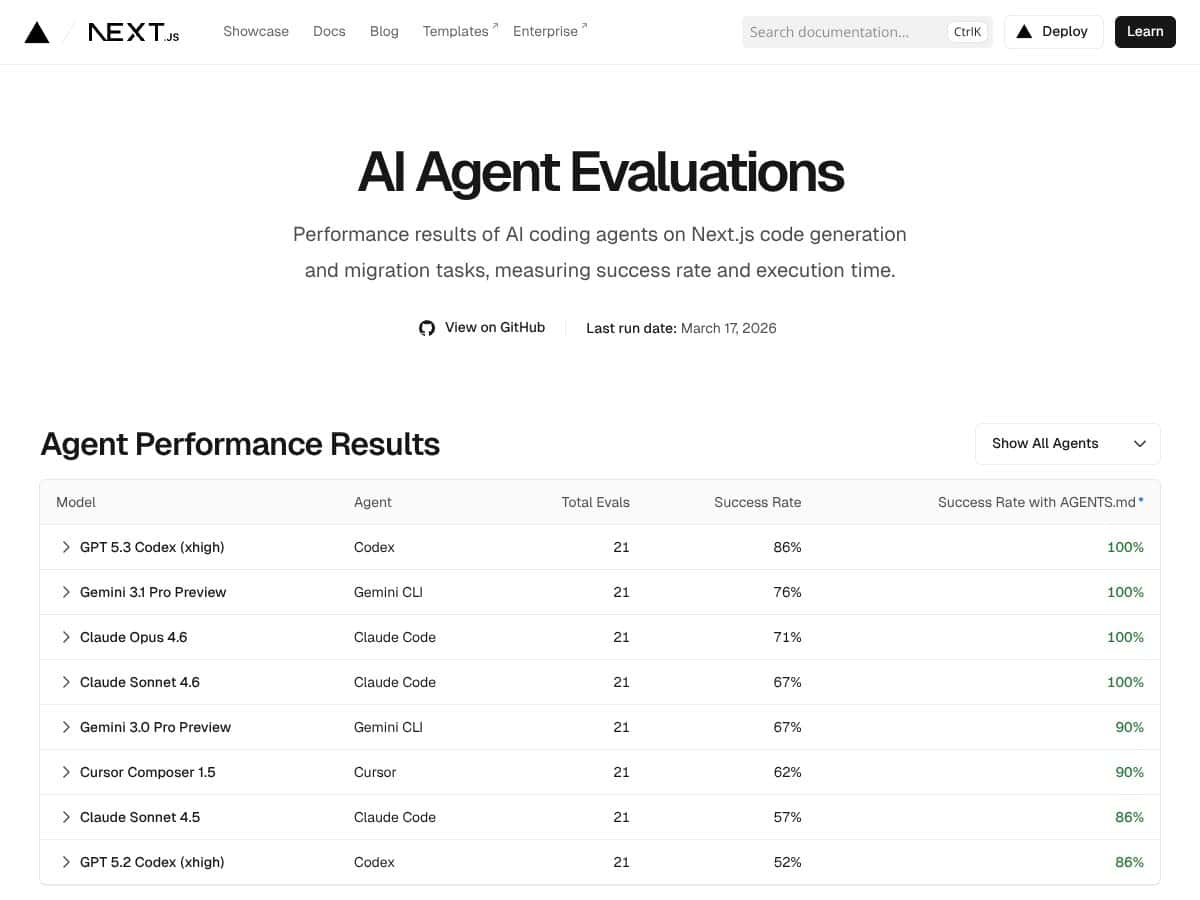

Lo que Next.js Evals realmente hace es bastante directo en la superficie: ejecuta diferentes modelos de IA—como GPT, Claude, Gemini—contra un conjunto de tareas de codificación predeterminadas de Next.js. Mide tasas de éxito y cuánto tiempo tarda cada IA en completar esas tareas. La idea es ofrecer a los desarrolladores datos para ayudar a decidir qué herramientas de IA valen la pena confiar al trabajar con código de Next.js. Así que, esencialmente, es un benchmark, pero centrado en desafíos de código relacionados con Next.js en lugar del rendimiento general de IA.

El caso es que Vercel—la empresa detrás de Next.js—está detrás de este proyecto. Eso le otorga cierta credibilidad; son los creadores de Next.js, así que tiene sentido que quieran ver cómo la IA puede apoyar a su ecosistema. Pero tenía un poco de escepticismo respecto a si esta herramienta es más que un conjunto de resultados estáticos. Después de todo, es un sitio de benchmarking, no un entorno interactivo ni un kit de herramientas para realizar migraciones reales o arreglos de código.

¿Mi impresión inicial? Es tal como se anuncia—al menos en lo que muestra: datos de rendimiento de varios modelos de IA en tareas específicas de Next.js. Pero no esperes funciones avanzadas ni formas de ejecutar tus propias pruebas personalizadas directamente en el sitio. Es más un tablero de puntuación que una herramienta de desarrollo. Además, quiero dejar claro que no está diseñado para una evaluación general de IA. Si buscas una tabla de clasificación completa de LLM o algo para comparar modelos en múltiples dominios, esto no lo es. Está estrechamente centrado en las tareas de Next.js.

Precios de Next.js Evals: ¿Vale la pena?

| Plan | Precio | Qué Obtiene | Mi Opinión |

|---|---|---|---|

| Plan Gratuito | Gratis | Acceso a métricas básicas de evaluación, los últimos resultados de benchmarks y datos de rendimiento de agentes de IA en tareas de Next.js. | Sinceramente, el plan gratuito probablemente es suficiente si solo quieres tener una idea de qué tan bien funcionan tus herramientas de IA en proyectos de Next.js. Pero los detalles son escasos y no está claro si existen límites de uso o si el plan gratuito cubre todas las funciones. |

| Planes de pago | No están publicados públicamente | Posiblemente informes más detallados, acceso a datos históricos o opciones de evaluación personalizadas—si existen. | Esto es sobre los precios: el sitio no especifica qué incluyen o cuestan los planes de pago. Si realmente quieres incorporar estos benchmarks en tu flujo de trabajo, podría ser necesario ponerse en contacto directamente con Vercel o esperar información más clara. Esta falta de transparencia podría ser un obstáculo para algunos. |

Entonces, ¿está bien de precio? Bueno, considerando que es código abierto y se centra en un nicho—evaluación de IA específica para Next.js—es difícil decirlo con certeza. Si lo comparas con herramientas generales de evaluación de IA como Hugging Face o LangChain, que a menudo cobran por funciones empresariales o hosting, esto parece ser más un recurso de benchmarks impulsado por la comunidad. Pero ojo: sin precios claros ni desgloses de funciones, es difícil evaluar su valor. Aviso: Si necesitas herramientas de evaluación robustas y personalizables o opciones de integración, esto podría no ser suficiente, especialmente porque la plataforma no parece ofrecer más que datos de benchmarking estáticos.

Lo Bueno y Lo Malo

Lo que me gustó

- Pruebas de referencia objetivas: Proporcionan tasas de éxito concretas y tiempos de ejecución, lo cual es invaluable al elegir entre herramientas de IA para tareas de Next.js. Ya no hay conjeturas: solo datos.

- Transparencia de código abierto: El repositorio de GitHub permite a cualquiera verificar, contribuir y entender exactamente cómo se ejecutan las pruebas de referencia. Eso es un gran punto a favor en mi opinión.

- Actualizaciones regulares: La última ejecución fue en febrero de 2026, por lo que los datos no están desactualizados. Demuestra un compromiso de mantener los benchmarks vigentes, lo cual es raro en este espacio.

- Cobertura de los modelos principales: Ver a GPT 5.3 Codex superar a otros con una tasa de éxito del 86-90% ofrece una visión clara de lo que es posible con la tecnología de IA actual en tareas de Next.js.

- Impacto de la documentación: La mención de AGENTS.md que aumenta las tasas de éxito sugiere que los agentes bien documentados rinden mejor; una idea útil para desarrolladores que optimizan sus flujos de trabajo de IA.

Qué podría mejorar

- Alcance limitado: Solo evalúa tareas específicas de Next.js. Si buscas una evaluación de IA más amplia o comparaciones entre marcos, esto no sirve.

- Falta de interfaz de usuario o herramientas interactivas: No hay panel de control, no hay ejecutor en tiempo real y no hay forma de probar tus propios modelos directamente. Todo se reduce a resultados estáticos, lo que limita la experimentación.

- Planes y características opacos: La ausencia de opciones de pago claras o características premium podría frustrar a los equipos que buscan más control o personalización.

- Sin testimonios ni casos de estudio: Sin historias de usuarios, es difícil evaluar el impacto real o la fiabilidad más allá de las puntuaciones brutas.

- Potencial de pruebas de rendimiento desactualizadas: Aunque la última corrida fue reciente, los modelos de IA evolucionan rápidamente. Si la plataforma no se actualiza regularmente, las pruebas de rendimiento podrían volverse menos relevantes con el tiempo.

¿Para quién es realmente Next.js Evals?

Si eres desarrollador o un equipo que trabaja intensamente con Next.js y generación de código con IA, especialmente si estás integrando agentes de IA en tu flujo de trabajo, esta herramienta puede servir como un punto de referencia útil. Piensa en ello como un tablero de puntuación de rendimiento que te ayuda a decidir qué modelos de IA generan o migran código de forma fiable en el ecosistema Next.js. Es ideal si buscas datos concretos en lugar de afirmaciones vagas.

Por ejemplo, si estás evaluando si GPT 5.3 Codex vale la pena invertir en tus proyectos de Next.js, estos indicadores te ofrecen tasas de éxito y tiempos de ejecución para respaldar esa decisión. Resulta especialmente útil si buscas optimizar tus flujos de trabajo de IA o comparar el rendimiento de diferentes modelos para tareas específicas como migración o generación de código.

Sin embargo, esto no es adecuado para alguien que busca un entorno de desarrollo completo, pruebas con conjuntos de datos personalizados o ajuste en tiempo real del rendimiento de IA. Es más bien una referencia de pruebas de rendimiento que una plataforma interactiva.

¿Quién debería buscar en otro lugar?

Si esperas un plugin completo para IDE, un entorno de pruebas en vivo o entrenamiento de modelos integrado, esta no es la herramienta para ti. Se centra estrictamente en la medición de rendimiento, así que si necesitas herramientas de evaluación más prácticas, personalizables o multi-framework, considera alternativas como LangChain Evals o el tablero de clasificación de Hugging Face.

Además, si eres principiante o recién estás empezando con IA en Next.js, confiar únicamente en pruebas de rendimiento estáticas podría no darte la imagen completa de lo que es posible. Los escenarios del mundo real suelen implicar matices que estas pruebas de rendimiento no cubren, así que no esperes que esto sustituya la experimentación práctica.

Por último, si la transparencia en precios o conjuntos de características detallados es imprescindible para tu equipo, ten en cuenta que la actual falta de información podría generar sorpresas o expectativas insatisfechas.

Cómo se compara Next.js Evals con las alternativas

LangChain Evals

LangChain Evals se centra más en evaluar modelos de lenguaje en el contexto del razonamiento paso a paso y flujos de trabajo de múltiples etapas. Ofrece un conjunto más amplio de pruebas de rendimiento que no son específicas de Next.js, pero que son útiles para la evaluación general de modelos de IA. En cuanto a precios, es de código abierto y gratuito como Next.js Evals, pero es más flexible para tareas de IA diversas.

Elige esto si necesitas un marco de evaluación versátil y de uso general que pueda manejar tareas de razonamiento complejas más allá del desarrollo web. Mantente con Next.js Evals si tu enfoque principal es evaluar a agentes de IA específicamente para la generación de código y la migración en Next.js, ya que ofrece pruebas de rendimiento más específicas y recientes para estas tareas.

OpenAI Evals

OpenAI Evals está diseñado para evaluar modelos de OpenAI específicamente, con un enfoque en sus modelos basados en API. Proporciona una forma de crear pruebas de rendimiento personalizadas y ejecutarlas contra los modelos de OpenAI, pero se trata menos de pruebas estandarizadas y más de evaluaciones personalizadas que configuras tú mismo. Es gratuito si usas la API de OpenAI, pero los costos pueden aumentar según el uso.

Elige esto si necesitas una integración estrecha con los modelos de OpenAI y quieres personalizar tus propias pruebas de rendimiento. Mantente con Next.js Evals si quieres pruebas de rendimiento listas para usar, específicas de Next.js y datos de rendimiento, especialmente si no trabajas exclusivamente con modelos de OpenAI.

Hugging Face Open LLM Leaderboard

Esta plataforma ofrece una comparación amplia de diferentes modelos de lenguaje en varias pruebas de rendimiento, incluyendo algunas relacionadas con tareas de código. Se trata más de comparar las capacidades generales de los modelos que de evaluar a tus agentes de IA específicos o tareas como la migración o la generación de código en Next.js. Es gratuita y está impulsada por la comunidad.

Elige esto si estás comparando el rendimiento general de varios modelos en distintas tareas. Mantente con Next.js Evals si tu objetivo es medir el rendimiento de los agentes de IA específicamente en flujos de trabajo de Next.js y tasas de éxito de la generación de código.

SWE-Bench y BigCodeBench

Estos son benchmarks especializados centrados en tareas de código de ingeniería de software, a menudo utilizados en investigación. Evalúan modelos en completado de código, corrección de errores y tareas similares, pero están menos orientados a marcos web como Next.js. Suelen ser herramientas académicas con acceso de código abierto.

Elige estos si te interesa una investigación profunda sobre IA para programación o si quieres evaluar modelos en tareas de código crudo. Next.js Evals es más práctico si buscas ideas directas sobre flujos de trabajo específicos de Next.js y éxitos de migración.

Conclusión: ¿Deberías probar Next.js Evals?

En general, diría que Next.js Evals obtiene un sólido 7/10. Es una herramienta de nicho, pero muy útil si trabajas específicamente con Next.js y quieres ver cómo se desempeñan diferentes agentes de IA en tareas de generación de código o migración. Es transparente, de código abierto y se actualiza con regularidad, lo que es un gran punto a favor.

¿Quién debería probarlo? Si eres un desarrollador de Next.js que experimenta con codificación asistida por IA o herramientas de migración, esto es una decisión obvia. Te ofrece ideas claras y basadas en datos sobre qué tan bien funcionan varios modelos en tus flujos de trabajo habituales.

¿Quién debería evitarlo? Si tu enfoque no es Next.js o marcos de desarrollo web, o si solo buscas benchmarks generales de IA, esta no es la herramienta adecuada. Es muy específica, así que para una evaluación de IA más amplia, considera alternativas como Hugging Face Leaderboard o LangChain Evals.

Sin duda vale la pena probar la capa gratuita, ya que es de código abierto y fácil de acceder. Si te tomas en serio el benchmarking y quieres ver cómo modelos como GPT 5.3 Codex se desempeñan en tus proyectos de Next.js, invertir tiempo en ello puede valer la pena. Actualizar o contribuir al repositorio de código abierto podría ser valioso si buscas ideas más personalizadas o para ayudar a mejorar los benchmarks.

¿Lo recomendaría personalmente? Si te interesa el desarrollo con Next.js y quieres mantener un ojo en el rendimiento de IA en ese ámbito, sí. No es perfecto y tiene limitaciones, pero es un recurso valioso para casos de uso específicos. Si buscas capacidades de IA más generales o apenas estás empezando, otras herramientas podrían servirte mejor.

Si estás muy invertido en Next.js y pruebas la fiabilidad de agentes de IA en tus flujos de trabajo, pruébalo. Si tus necesidades son más generales o buscas benchmarks para varios frameworks, vale la pena invertir tu dinero y tiempo explorando alternativas como Hugging Face o LangChain.

Preguntas comunes sobre Next.js Evals

- ¿Vale la pena Next.js Evals el dinero? Es gratis, así que no hay costo monetario. Vale la pena si buscas benchmarks personalizados para tareas de Next.js, pero tiene un alcance limitado.

- ¿Existe una versión gratuita? Sí, es de código abierto y gratuita para usar a través de GitHub y del sitio web de Next.js.

- ¿Cómo se compara con [competitor]? En comparación con Hugging Face o OpenAI Evals, Next.js Evals está más especializado para flujos de trabajo de Next.js, mientras que otros son más amplios o más configurables.

- ¿Puedo obtener un reembolso? No aplica, ya que es de código abierto y gratuito.

- ¿Qué modelos admite? Admite modelos como GPT, Gemini CLI, Claude Code y Cursor, con benchmarks recientes que muestran que GPT 5.3 Codex obtiene el mejor rendimiento.

- ¿Con qué frecuencia se actualizan los benchmarks? La última ejecución fue el 18 de febrero de 2026, y las actualizaciones dependen de las contribuciones de la comunidad.

- ¿Puedo contribuir o personalizar los benchmarks? Sí, es de código abierto y puedes contribuir al repositorio de GitHub o personalizar los benchmarks según tus necesidades.

- ¿Es fácil de usar? Está diseñado para desarrolladores familiarizados con IA y Next.js, pero es directo si sigues la documentación.