¿Qué es Qwen3.5 Small?

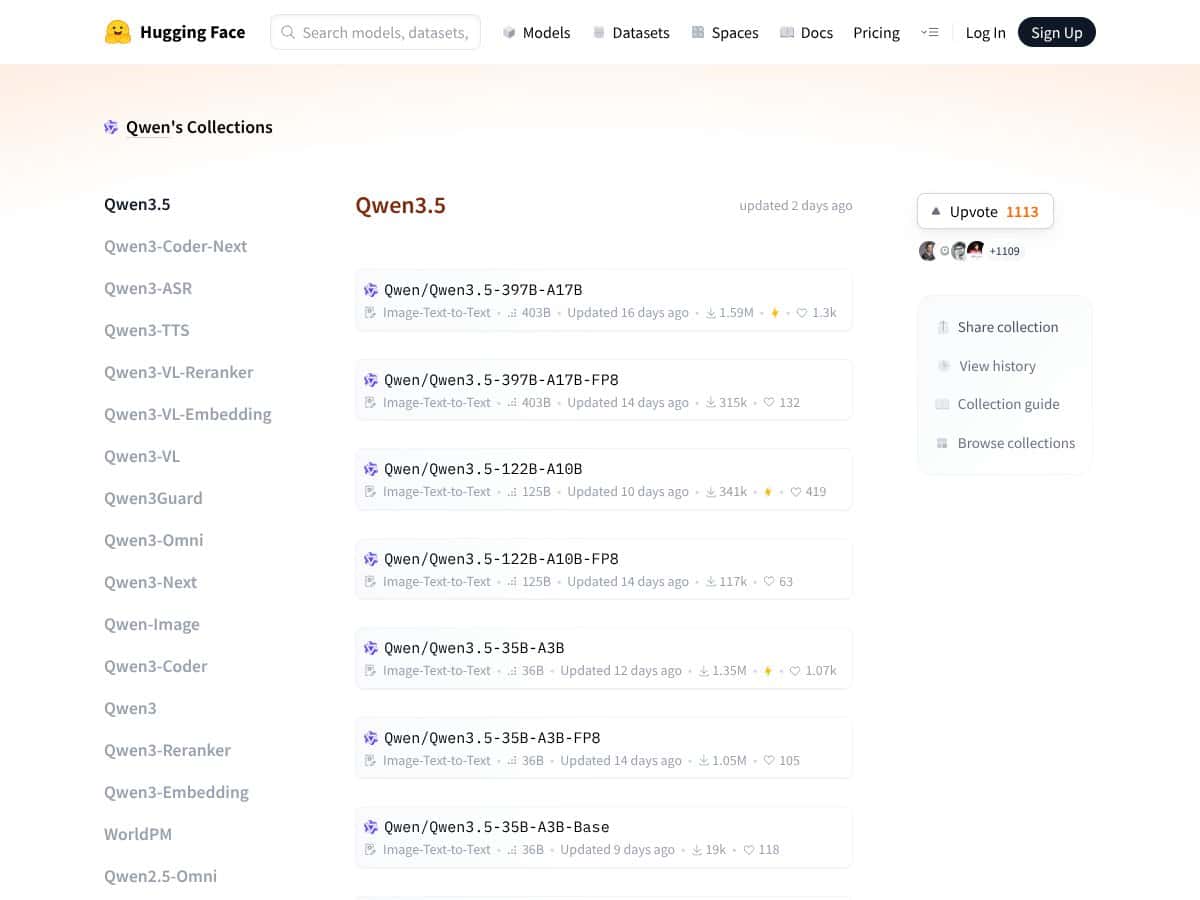

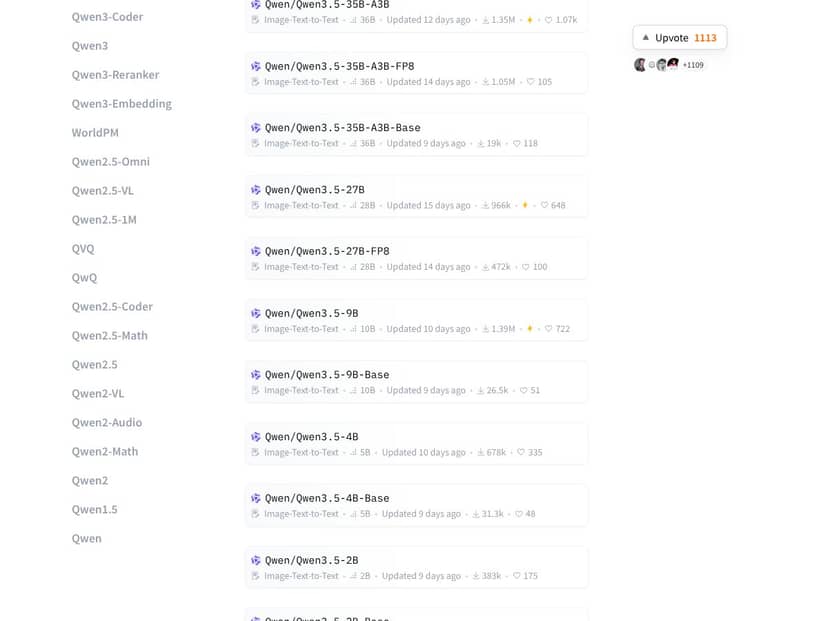

Honestamente, he estado muy curioso acerca de todo el bombo en torno a modelos de IA optimizados para el borde últimamente, especialmente aquellos que afirman hacer mucho sin necesitar una infraestructura pesada en la nube. Eso es lo que me atrajo de Qwen3.5 Small — un modelo ligero y de código abierto de Alibaba diseñado para ejecutarse en tu portátil o incluso en un teléfono inteligente, no solo en centros de datos masivos. Promete capacidades multimodales (texto, imágenes, interacción con la interfaz de usuario) y la capacidad de procesar documentos largos, todo mientras consume pocos recursos.

Lo que realmente hace, en lenguaje claro, es funcionar como una especie de asistente de IA que puede entender y generar texto, interpretar imágenes e incluso interactuar con interfaces de usuario. Piensa en ello como un mini cerebro de IA que puedes ejecutar sin conexión, capaz de tareas como analizar fotos, seguir flujos de trabajo de múltiples pasos o simplemente conversar sin necesitar una conexión a Internet. El principal problema que busca resolver es hacer que modelos de IA potentes sean accesibles para usuarios cotidianos, especialmente aquellos que se preocupan por la privacidad o que no quieren depender de servicios en la nube que pueden ser lentos o costosos.

En cuanto a quién está detrás, Alibaba es el nombre principal asociado con estos modelos, y han estado bastante activos lanzando variantes de IA de código abierto últimamente. Yo era inicialmente escéptico —como siempre con IA de código abierto—, pero tengo que admitir que el hecho de que cuente con el respaldo de una gran empresa le da un poco más de credibilidad que algunos proyectos anónimos de GitHub.

¿Mi primera impresión? Más o menos coincide con lo que sugieren la documentación y el bombo: un modelo más pequeño y eficiente que puede hacer mucho de lo que hacen los modelos más grandes, pero a una escala menor. Sin embargo, quiero dejar claro desde el inicio que no es una herramienta plug-and-play con una interfaz elegante ni una API basada en la nube. Es principalmente un modelo que descargas, ejecutas localmente y luego descubres cómo usarlo mediante código o línea de comandos. Si esperas una aplicación elegante o una integración sin complicaciones, podrías quedar decepcionado.

De hecho, no hay UI oficial, no hay tienda de apps y no hay panel de control — básicamente es un conjunto de modelos y scripts. Así que no esperes algo que “funcione tal cual” de inmediato si no te sientes cómodo con configuraciones técnicas. Eso es un aviso importante para cualquiera que espere un asistente de IA listo para usar.

Precios de Qwen3.5 Small: ¿Vale la pena?

| Plan | Precio | Qué obtienes | Mi opinión |

|---|---|---|---|

| Plan Gratuito | Desconocido | Probablemente acceso a modelos básicos, con uso o características posiblemente limitadas | Honestamente, no pude encontrar detalles específicos. Si realmente es gratuito, podría valer la pena probarlo, pero espera restricciones. |

| Planes de pago | Consultar el sitio web | Posible acceso a modelos más grandes, soporte prioritario o funciones mejoradas | Este es el tema de los precios... sin detalles claros, es difícil evaluar el valor. Como estos son modelos de código abierto, los costos pueden estar relacionados principalmente con el hosting o la implementación. Tenga cuidado con costos ocultos o límites que no estén claramente especificados. |

¿Mi valoración honesta? Si Alibaba o el proveedor de hosting cobra por el acceso, podría sumar rápido, especialmente si haces inferencia intensiva. Dado que los modelos son de código abierto bajo Apache 2.0, técnicamente podrías ejecutarlos localmente de forma gratuita, siempre que cuentes con el hardware adecuado. Pero si quieres un servicio alojado con soporte, espera pagar. Asegúrate de verificar cualquier límite de uso, llamadas a la API o restricciones de características antes de comprometerte.

¿Para quién tiene sentido esto? Si eres desarrollador o investigador que busca experimentar localmente o con un presupuesto modesto, y te sientes cómodo gestionando el despliegue por tu cuenta, entonces el modelo de código abierto es una buena opción. Si prefieres un servicio totalmente gestionado con costos predecibles, consulta las opciones de hosting o alternativas de APIs comerciales.

Lo bueno y lo malo

Lo que me gustó

- Rendimiento potente en un paquete compacto: La variante 9B que alcanza 81.7 en GPQA Diamond es impresionante, especialmente dado su tamaño. Es un claro avance frente a muchos otros modelos ligeros.

- Capacidades multimodales nativas: Poder procesar imágenes, texto e incluso capturas de pantalla de la interfaz de usuario sin módulos adicionales es un cambio radical para aplicaciones en el borde.

- Funcionamiento sin conexión y privacidad: No depender de la nube, lo que mantiene los datos sensibles localmente, lo que es una gran ventaja para empresas o usuarios preocupados por la privacidad.

- Licencia de código abierto: La licencia Apache 2.0 significa libertad para personalizar, redistribuir y desplegar sin tarifas de licencia.

- Soporte multilingüe: Más de 200 idiomas con uso eficiente de tokens, especialmente útil para proyectos o apps globales.

- Eficiencia de recursos: La arquitectura híbrida permite ejecutarlo en hardware de consumo, haciéndolo accesible más allá de los grandes centros de datos.

Qué podría mejorar

- Alto consumo de tokens durante el razonamiento: Los modelos, especialmente en sus tareas de razonamiento, tienden a usar más tokens que modelos comparables, lo que podría implicar costos de inferencia más altos o respuestas más lentas en la práctica.

- Razonamiento por defecto desactivado: Necesitas habilitar manualmente las capacidades de razonamiento, lo cual podría resultar confuso para los recién llegados o para quienes esperan funcionalidad lista para usar.

- Datos de rendimiento limitados en escenarios reales: La mayoría de los datos de rendimiento son académicos; no está claro cómo se desempeñan estos modelos en tareas complejas del mundo real o en entornos de producción.

- Limitaciones de los modelos más pequeños: Las variantes de 0.8B o 2B, aunque ligeras, muestran capacidades significativamente reducidas, por lo que podrían no satisfacer casos de uso exigentes.

- Falta de información de precios clara: Sin costos explícitos, es difícil planificar presupuestos, especialmente si se despliega a gran escala o en producción.

¿Para quién es realmente Qwen3.5 Small?

Si eres desarrollador, investigador o entusiasta que busca un modelo de IA capaz y de código abierto que pueda ejecutarse localmente en hardware de consumo, este podría ser tu mejor opción. Especialmente si tu trabajo implica datos multimodales — imágenes, capturas de pantalla de interfaces y contenido estructurado — y valoras la privacidad y el funcionamiento sin conexión.

Por ejemplo, si estás desarrollando una aplicación móvil que necesite analizar imágenes y texto sin depender de APIs en la nube, o una herramienta de automatización de escritorio que navegue por interfaces y complete formularios, las capacidades visuales basadas en agentes de Qwen3.5 Small son una gran ventaja. También es adecuado para proyectos multilingües o aquellos que requieren ventanas de contexto extendidas para documentos largos.

Sin embargo, si tu enfoque es un despliegue a nivel empresarial con costos predecibles, o si necesitas una precisión de razonamiento extremadamente alta sin configuración personalizada, podrías encontrar ciertos límites. Además, quienes esperan capacidades de razonamiento listas para usar o un uso mínimo de tokens pueden necesitar buscar en otro lugar o estar preparados para ajustar los modelos.

Quiénes deberían buscar en otro lugar

Si tu objetivo principal es servicios de IA fáciles de usar, basados en la nube y con precios simples, esto no es para ti. Las aplicaciones comerciales a gran escala que requieren tiempo de actividad garantizado, soporte o acuerdos de nivel de servicio (SLA) probablemente no lo encontrarán adecuado. También, si necesitas modelos con benchmarks probados en escenarios reales que cubran una variedad de tareas, como diálogos complejos, generación de contenido de larga duración o conocimiento específico de un dominio, quizá te sientas decepcionado.

Finalmente, si no te sientes cómodo implementando modelos de código abierto por ti mismo, o si no cuentas con los recursos de hardware para la inferencia local, entonces una API gestionada de proveedores como OpenAI, Anthropic o Google podría ser más adecuada, incluso si implica costos continuos y compromisos de privacidad.

{"pros": ["Relación rendimiento-tamaño excepcional, especialmente en la variante 9B, que permite razonamiento de alto nivel en hardware de borde.","Capacidades multimodales nativas que procesan imágenes, texto y capturas de pantalla de la interfaz de usuario sin módulos adicionales.","Operación completamente sin conexión garantiza la privacidad de los datos y reduce la latencia, ideal para aplicaciones sensibles o remotas.","Licencia de código abierto (Apache 2.0) ofrece flexibilidad para personalización y redistribución.","Soporta más de 200 idiomas con uso eficiente de tokens, ampliando su usabilidad internacional."],"cons": ["Consumo de tokens alto durante tareas de razonamiento, lo que podría aumentar los costos de inferencia y los tiempos de respuesta." ,"Las capacidades de razonamiento están deshabilitadas por defecto, requiriendo configuración manual, lo que puede resultar confuso." ,"Pocas referencias de rendimiento en escenarios reales, dificultando evaluaciones prácticas de despliegue." ,"Modelos más pequeños como 0.8B o 2B pueden no satisfacer las necesidades de aplicaciones exigentes debido a capacidades reducidas." ,"Falta de detalles de precios transparentes, lo que dificulta la planificación presupuestaria."],"useCases": ["Aplicaciones de IA multimodal locales en dispositivos móviles o de escritorio donde la privacidad es primordial.","Herramientas de automatización de UI que navegan e interactúan con interfaces de aplicaciones mediante datos visuales.","Análisis o procesamiento de documentos de formato largo en entornos sin conexión.","Análisis y generación de contenido multilingüe para proyectos globales.","Experimentos de investigación que requieren modelos personalizables de código abierto con capacidades de contexto extendido."]}Cómo se compara Qwen3.5 Small frente a alternativas

Gemini 2.5 Flash-Lite

- Qué hace de manera diferente: Gemini 2.5 Flash-Lite está optimizado para razonamiento visual y tareas multimodales, pero es más pequeño y ligero, enfocado en inferencia rápida en lugar de razonamiento profundo. Por lo general, está diseñado para uso en el dispositivo con menos énfasis en capacidades multimodales extensas.

- Comparación de precios: Generalmente disponible a través de API con costos basados en el uso; los modelos más pequeños suelen ser más baratos que los más grandes como Qwen3.5, pero los precios exactos varían según el proveedor y la escala.

- Elige este si... Necesitas un modelo ligero y rápido de razonamiento visual para tareas simples y estás de acuerdo con un rendimiento de razonamiento menor.

- Quédate con Qwen3.5 Small si... Quieres un modelo más capaz, multimodal, con un soporte de idiomas más amplio y un razonamiento superior, especialmente si la operación offline es importante.

Ministral 3 8B

- Qué hace de manera diferente: Ministral 3 se centra en la comprensión y el razonamiento del lenguaje de uso general, con un tamaño más compacto (8B) y menos énfasis en características multimodales. Es más bien un LLM tradicional con cierto ajuste fino para tareas de razonamiento.

- Comparación de precios: De código abierto, por lo que es gratis de usar; los costos de despliegue dependen de la infraestructura, pero no hay tarifas de licencia.

Serie Qwen3 VL

- Qué lo hace diferente: La generación anterior de modelos Qwen, con un rendimiento multimodal más bajo, estaba diseñada principalmente para tareas de texto e imágenes básicas, sin las ventanas de contexto extendidas ni las capacidades visuales agentivas.

- Comparación de precios: De código abierto, un modelo similar de uso libre, pero potencialmente menos capaz en tareas multimodales que la serie Small.

- Elige esto si... Estás bien con funciones multimodales menos avanzadas y quieres un modelo ligero para tareas básicas de texto/imagen.

- Quédate con Qwen3.5 Small si... Necesitas capacidades multimodales de vanguardia y un manejo de contexto más amplio.

OpenAI GPT-OSS 120B

- Qué lo hace diferente: Este es un modelo mucho más grande, basado en la nube, que ofrece razonamiento y comprensión del lenguaje de primer nivel pero requiere hardware significativo o acceso a la nube.

- Comparación de precios: Uso de API de pago, a menudo costoso, especialmente para tareas de alto volumen; en comparación con modelos gratuitos o de código abierto, es más caro pero muy capaz.

- Elige esto si... Necesitas el mejor razonamiento y comprensión del lenguaje en la nube, y el costo es menos relevante.

- Quédate con Qwen3.5 Small si... Prefieres soluciones fuera de línea enfocadas en la privacidad y no quieres depender de APIs en la nube.

Conclusión: ¿Deberías probar Qwen3.5 Small?

En general, diría que Qwen3.5 Small es un sólido 7/10. Es impresionante para su tamaño: ofrece un razonamiento de vanguardia en un paquete compacto de código abierto, y las funciones multimodales son un verdadero cambio de juego para modelos pequeños. Es perfecto si buscas privacidad, operación fuera de línea y soporte multilingüe sin gastar mucho. Pero ojo con su alto consumo de tokens y el razonamiento desactivado por defecto, lo que puede complicar a los recién llegados.

Si eres alguien que quiere ejecutar IA localmente en un buen portátil o teléfono inteligente y estás dispuesto a hacer algunos ajustes, esto definitivamente vale la pena probar. La licencia de código abierto significa que puedes personalizarlo libremente, lo cual es una gran ventaja. Sin embargo, si necesitas el mejor rendimiento de razonamiento posible y estás cómodo con depender de la nube y con costos más altos, modelos más grandes como GPT-4 o GPT-OSS 120B podrían ser mejores.

Personalmente, recomiendo probar la versión gratuita si tienes curiosidad. Actualizar a una configuración de pago tiene sentido solo si manejas cargas de trabajo pesadas o necesitas funciones empresariales específicas. Si la privacidad sin conexión y las capacidades multimodales son tu prioridad, Qwen3.5 Small es una opción atractiva. De lo contrario, considera alternativas que se ajusten mejor a tus necesidades específicas.

En resumen: si quieres un modelo multimodal versátil y de código abierto que funcione en tu hardware, pruébalo. Si buscas razonamiento puro y de alto nivel y no te importa la nube, busca en otro lugar.

Preguntas comunes sobre Qwen3.5 Small

- ¿Vale la pena usar Qwen3.5 Small?

- Es gratuito descargarlo y usarlo debido a su licencia de código abierto, pero los costos de implementación dependen de tu hardware e infraestructura. Es una buena relación calidad-precio para uso fuera de línea y centrado en la privacidad.

- ¿Hay una versión gratuita?

- Sí, los modelos son de código abierto y gratuitos. Sin embargo, ejecutarlos de forma eficiente puede requerir hardware que ya tienes o recursos en la nube por los que pagas.

- ¿Cómo se compara con GPT-4 o GPT-OSS 120B?

- Qwen3.5 Small ofrece un razonamiento impresionante para su tamaño y puede funcionar localmente, pero en general no iguala la potencia bruta de modelos en la nube más grandes como GPT-4 en tareas complejas.

- ¿Puede realizar análisis de video o automatización de la interfaz de usuario?

- Sí, las capacidades multimodales incluyen análisis de video y navegación por la interfaz de usuario, lo que lo hace más versátil que la mayoría de los modelos pequeños.

- ¿El razonamiento está habilitado por defecto?

- No, el razonamiento está desactivado en los modelos Small, pero se puede activar con una configuración.

- ¿Puedo obtener un reembolso?

- Como es de código abierto, no hay un proceso de compra o reembolso. Puedes descargarlo y experimentar con él libremente.