Was ist Qwen3.5 Small?

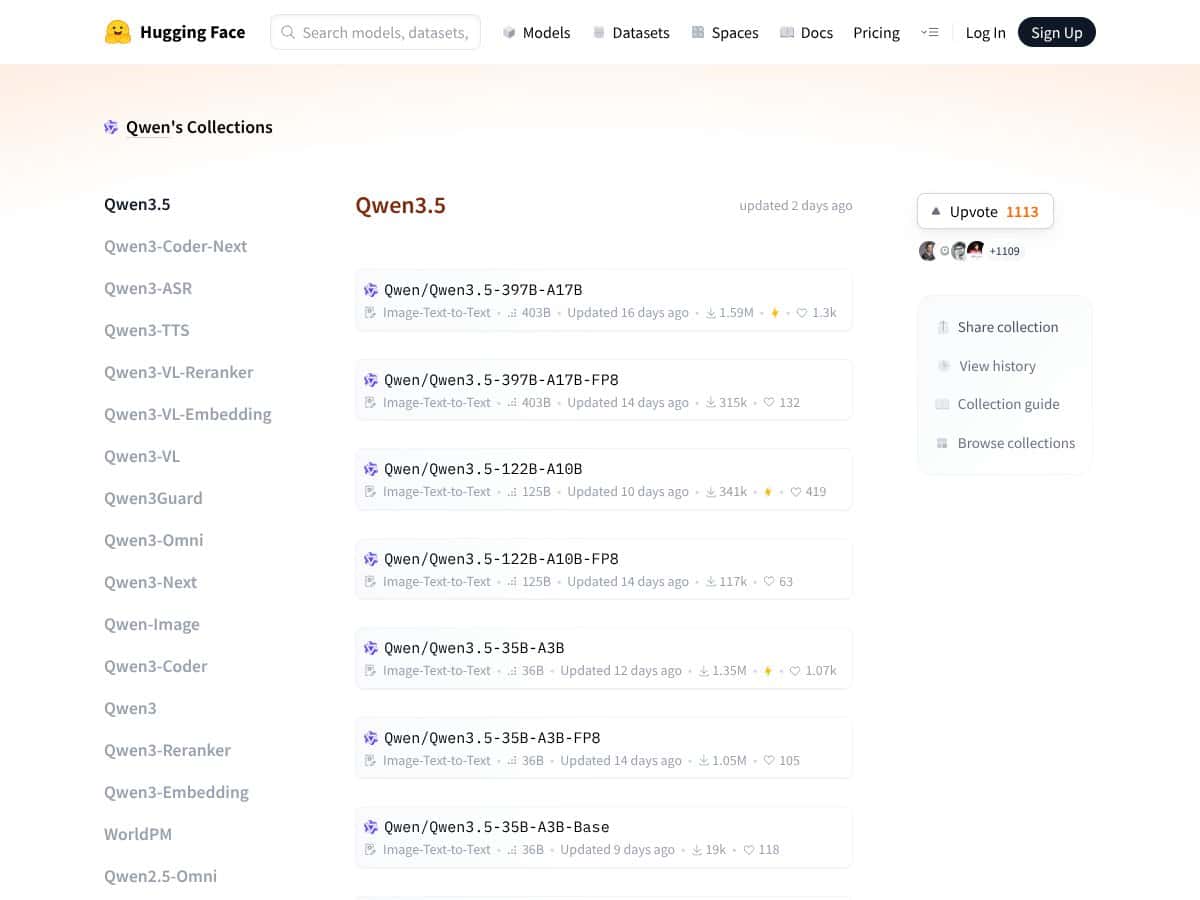

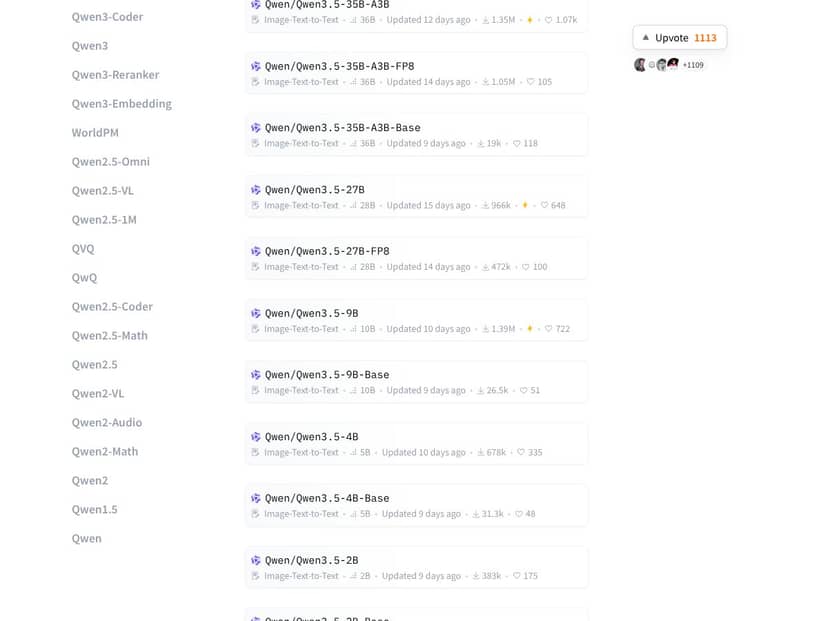

Offen gesagt war ich in letzter Zeit ziemlich neugierig auf den ganzen Hype um Edge-Computing-fähige KI-Modelle, insbesondere solche, die behaupten, viel zu leisten, ohne eine schwere Cloud-Infrastruktur zu benötigen. Das ist es, was mich zu Qwen3.5 Small gezogen hat — ein leichtgewichtiges, Open-Source-Modell von Alibaba, das darauf ausgelegt ist, auf Ihrem Laptop oder sogar einem Smartphone zu laufen, nicht nur in riesigen Rechenzentren. Es verspricht multimodale Fähigkeiten (Text, Bilder, UI-Interaktion) und die Fähigkeit, lange Dokumente zu verarbeiten, alles bei ressourcenschonender Nutzung.

Was es tatsächlich tut, einfach ausgedrückt, ist eine Art KI-Assistent, der Texte verstehen und erzeugen, Bilder interpretieren und sogar mit Benutzeroberflächen interagieren kann. Stellen Sie es sich als ein kleines KI-Hirn vor, das Sie offline ausführen können und das Aufgaben wie die Analyse von Fotos, das Befolgen mehrstufiger Arbeitsabläufe oder einfach nur Chatten ermöglicht, ohne Internetverbindung. Das Hauptproblem, das es lösen will, besteht darin, leistungsstarke KI-Modelle für den Alltag zugänglich zu machen, insbesondere für diejenigen, die Wert auf Privatsphäre legen oder sich nicht auf Cloud-Dienste verlassen möchten, die langsam oder teuer sein können.

Was die Hintermänner betrifft, ist Alibaba der Hauptname, der mit diesen Modellen assoziiert wird, und sie waren in letzter Zeit ziemlich aktiv bei der Veröffentlichung Open-Source-KI-Varianten. Ich war zunächst skeptisch — wie immer bei Open-Source-KI — aber ich muss zugeben, dass die Tatsache, dass es von einem Großunternehmen unterstützt wird, ihm etwas mehr Glaubwürdigkeit verleiht als ein anonymes GitHub-Projekt.

Mein erster Eindruck? Es entspricht grob dem, was die Dokumentation und der Hype nahelegen: ein kleineres, effizientes Modell, das viel von dem leisten kann, was größere Modelle tun, aber im kleineren Maßstab. Was ich jedoch im Vorfeld klarstellen möchte, ist, dass es kein Plug-and-Play-Tool mit einer schicken Oberfläche oder einer cloudbasierten API ist. Es ist in erster Linie ein Modell, das Sie herunterladen, lokal ausführen und dann per Code oder Kommandozeile nutzen müssen. Wenn Sie eine schicke App oder nahtlose Integration erwarten, könnten Sie enttäuscht sein.

Tatsächlich gibt es keine offizielle Benutzeroberfläche, keinen App-Store und kein Dashboard — es ist im Wesentlichen eine Sammlung von Modellen und Skripten. Erwarten Sie also nichts, das „out of the box“ einfach funktioniert, wenn Sie sich nicht mit technischen Setups auskennen. Das ist eine wichtige Vorabinfo für jeden, der sich eine fertige KI-Assistentin oder einen fertigen KI-Assistenten erhofft.

Qwen3.5 Small Preisgestaltung: Lohnt es sich?

| Plan | Preis | Was Sie erhalten | Meine Einschätzung |

|---|---|---|---|

| Kostenloser Tarif | Unbekannt | Wahrscheinlich Zugriff auf grundlegende Modelle, möglicherweise eingeschränkte Nutzung oder Funktionen | Offen gesagt konnte ich keine konkreten Details finden. Wenn es wirklich kostenlos ist, könnte es sich lohnen, damit zu experimentieren, aber mit Einschränkungen ist zu rechnen. |

| Kostenpflichtige Tarife | Auf der Website prüfen | Möglicher Zugriff auf größere Modelle, Priorität beim Support oder erweiterte Funktionen | Zur Preisgestaltung: Ohne klare Details ist es schwer, den Wert zu beurteilen. Da es sich um Open-Source-Modelle handelt, könnten die Kosten hauptsächlich mit Hosting oder Bereitstellung zusammenhängen. Achten Sie auf versteckte Kosten oder Limits, die nicht eindeutig beschrieben sind. |

Meine ehrliche Einschätzung? Wenn Alibaba oder der Hosting-Anbieter Gebühren für den Zugriff erhebt, könnte es schnell teuer werden, insbesondere wenn Sie intensive Inferenz durchführen. Da die Modelle unter Apache-2.0-Lizenz stehen, könnten Sie sie technisch gesehen lokal kostenlos betreiben – vorausgesetzt, Sie verfügen über passende Hardware. Wenn Sie jedoch einen gehosteten Dienst mit Support wünschen, müssen Sie mit Kosten rechnen. Vergewissern Sie sich, vor einem Abschluss Nutzungsbeschränkungen, API-Aufrufe oder Funktionsgrenzen zu prüfen.

Für wen macht das Sinn? Wenn Sie Entwickler oder Forscher sind und lokal oder mit überschaubarem Budget experimentieren möchten und die Bereitstellung selbst managen können, ist das Open-Source-Modell ein Gewinn. Wenn Sie einen vollständig verwalteten Dienst mit vorhersehbaren Kosten bevorzugen, prüfen Sie Hosting-Optionen oder alternative kommerzielle APIs.

Das Gute und das Schlechte

Was mir gefallen hat

- Leistungsstarke Performance in kleinem Format: Die 9B-Variante, die 81,7 auf GPQA Diamond erreicht, ist beeindruckend — insbesondere bei ihrer Größe. Das ist eindeutig eine Steigerung gegenüber vielen anderen leichten Modellen.

- Native multimodale Fähigkeiten: Die Verarbeitung von Bildern, Texten und sogar UI-Screenshots ohne zusätzliche Module ist ein echter Game-Changer für Edge-Anwendungen.

- Offline-Betrieb und Datenschutz: Keine Abhängigkeit von der Cloud bedeutet, dass sensible Daten lokal bleiben – ein großer Vorteil für Unternehmen oder datenschutzbewusste Nutzer.

- Open-Source-Lizenzierung: Die Apache-2.0-Lizenz bedeutet Freiheit zur Anpassung, Weiterverbreitung und Bereitstellung ohne Lizenzgebühren.

- Mehrsprachige Unterstützung: Mehr als 200 Sprachen mit effizienter Token-Nutzung – besonders nützlich für globale Projekte oder Apps.

- Ressourceneffizienz: Die Hybrid-Architektur ermöglicht den Betrieb auf Consumer-Hardware, wodurch es auch außerhalb großer Rechenzentren zugänglich wird.

Was besser sein könnte

- Hoher Tokenverbrauch beim Schlussfolgern: Die Modelle neigen, insbesondere bei ihren Schlussfolgerungsaufgaben, dazu, mehr Tokens zu verwenden als vergleichbare Modelle, was zu höheren Inferenzkosten oder langsamer Reaktionszeit in der Praxis führen könnte.

- Standardmäßige Begründung deaktiviert: Sie müssen Begründungsfähigkeiten manuell aktivieren, was für Neulinge oder diejenigen, die eine Out-of-the-Box-Funktionalität erwarten, verwirrend sein könnte.

- Begrenzte Benchmarks aus der realen Welt: Der Großteil der Leistungsdaten stammt aus akademischen Studien – es ist unklar, wie sich diese Modelle bei komplexen realen Aufgaben oder in Produktionsumgebungen schlagen.

- Beschränkungen kleinerer Modelle: Die Varianten 0.8B bzw. 2B sind zwar leichtgewichtig, zeigen jedoch deutlich eingeschränktere Fähigkeiten und könnten anspruchsvolle Anwendungsfälle nicht erfüllen.

- Fehlende klare Preisangaben: Ohne explizite Kosten ist es schwer, Budgets zu planen – insbesondere wenn der Einsatz skaliert oder in der Produktion erfolgt.

Für wen ist Qwen3.5 Small eigentlich geeignet?

Wenn Sie Entwickler, Forscher oder Enthusiast sind, der nach einem leistungsfähigen, Open-Source-KI-Modell sucht, das lokal auf Hardware des Endverbrauchers laufen kann, könnte dies Ihre beste Option sein. Insbesondere wenn Ihre Arbeit multimodale Daten umfasst – Bilder, Benutzeroberflächen-Screenshots und strukturierte Inhalte – und Sie Privatsphäre sowie Offline-Betrieb schätzen.

Zum Beispiel, wenn Sie eine mobile App entwickeln, die Bilder und Texte analysieren muss, ohne auf Cloud-APIs angewiesen zu sein, oder ein Desktop-Automatisierungstool, das Benutzeroberflächen navigiert und Formulare ausfüllt, sind die visuellen Agentenfähigkeiten von Qwen3.5 Small ein großer Vorteil. Es eignet sich auch für mehrsprachige Projekte oder solche, die erweiterte Kontextfenster für lange Dokumente benötigen.

Aber wenn Ihr Fokus auf einer unternehmensweiten Bereitstellung mit vorhersehbaren Kosten liegt oder Sie eine ultra-hohe Begründungsgenauigkeit ohne benutzerdefinierte Konfiguration benötigen, stoßen Sie möglicherweise an Grenzen. Außerdem könnten diejenigen, die nach Out-of-the-Box-Begründungsfähigkeiten oder minimalem Tokenverbrauch suchen, woanders fündig werden oder die Modelle entsprechend anpassen müssen.

Für wen ist Qwen3.5 Small nicht geeignet?

Wenn Ihr Hauptziel cloudbasierte, benutzerfreundliche KI-Dienste mit klaren Preisen sind, ist dies nicht das Richtige für Sie. Groß angelegte kommerzielle Anwendungen, die eine garantierte Verfügbarkeit, Support oder SLA erfordern, werden wahrscheinlich nicht geeignet sein. Außerdem, wenn Sie Modelle mit nachweislich realweltlichen Benchmarks über eine Vielzahl von Aufgaben benötigen – wie komplexe Dialoge, lange Textgenerierung oder domänenspezifisches Wissen – könnten Sie enttäuscht sein.

Schließlich, wenn Sie sich nicht wohl dabei fühlen, Open-Source-Modelle selbst bereitzustellen, oder Ihnen die Hardware-Ressourcen für die lokale Inferenz fehlen, könnte eine verwaltete API von Anbietern wie OpenAI, Anthropic oder Google besser zu Ihnen passen – auch wenn damit laufende Kosten und Datenschutz-Nachteile verbunden sind.

{"pros": ["Herausragendes Verhältnis von Leistung zu Größe, insbesondere in der 9B-Variante, das hochstufiges Schlussfolgern auf Edge-Hardware ermöglicht.","Native multimodale Fähigkeiten, die Bilder, Text und UI-Screenshots ohne zusätzliche Module verarbeiten.","Vollständiger Offline-Betrieb gewährleistet Datenschutz und reduziert Latenz, ideal für sensible oder abgelegene Anwendungen.","Open-Source-Lizenzierung (Apache 2.0) bietet Flexibilität bei Anpassung und Weiterverbreitung.","Unterstützt über 200 Sprachen mit effizienter Token-Nutzung, was die internationale Nutzbarkeit erweitert."],"cons": ["Hoher Token-Verbrauch während Schlussfolgerungsaufgaben, was die Inferenzkosten und Antwortzeiten erhöhen kann." ,"Schlussfolgerungsfähigkeiten sind standardmäßig deaktiviert und erfordern manuelle Konfiguration, was verwirrend sein kann." ,"Begrenzte reale Leistungsbenchmarks, wodurch praktische Bereitstellungsbewertungen schwierig werden." ,"Kleinere Modelle wie 0.8B oder 2B erfüllen möglicherweise nicht die Anforderungen anspruchsvoller Anwendungen aufgrund geringerer Leistungsfähigkeit." ,"Fehlende transparente Preisinformationen, was Budgetplanung erschwert."],"useCases": ["Lokale multimodale KI-Anwendungen auf Mobil- oder Desktop-Geräten, bei denen Privatsphäre an erster Stelle steht.","UI-Automatisierungstools, die App-Oberflächen mit visuellen Daten navigieren und interagieren.","Langform-Dokumentenanalyse oder -verarbeitung in Offline-Umgebungen.","Mehrsprachige Inhaltsanalyse und -erstellung für globale Projekte.","Forschungsversuche, die anpassbare Open-Source-Modelle mit erweitertem Kontext benötigen."]}Wie schneidet Qwen3.5 Small im Vergleich zu Alternativen ab

Gemini 2.5 Flash-Lite

- Was es anders macht: Gemini 2.5 Flash-Lite ist auf visuelles Schlussfolgern und multimodale Aufgaben optimiert, dabei jedoch kleiner und leichter, mit Fokus auf schnelle Inferenzen statt auf tiefgehendes Schlussfolgern. Es ist in der Regel für die Nutzung direkt auf dem Gerät konzipiert und legt weniger Wert auf umfangreiche multimodale Fähigkeiten.

- Preisvergleich: In der Regel über eine API mit nutzungsbasierenden Kosten erhältlich; kleinere Modelle sind tendenziell günstiger als größere Modelle wie Qwen3.5, aber die genauen Preise variieren je nach Anbieter und Skalierung.

- Wählen Sie dies, wenn... Sie benötigen ein leichtgewichtiges, schnelles Modell für visuelles Schlussfolgern bei einfachen Aufgaben und sind mit einer geringeren Schlussfolgerungsleistung einverstanden.

- Behalten Sie Qwen3.5 Small bei, wenn... Sie möchten ein leistungsfähigeres, multimodales Modell mit breiterer Sprachunterstützung und besserem Schlussfolgern, insbesondere wenn der Offline-Betrieb wichtig ist.

Ministral 3 8B

- Worin es sich von anderen unterscheidet: Ministral 3 konzentriert sich auf allgemeines Sprachverständnis und Schlussfolgerungen, hat eine kleinere Größe (8B) und weniger Schwerpunkt auf multimodale Merkmale. Es ist eher ein traditionelles LLM mit Feinabstimmung für Reasoning-Aufgaben.

- Preisvergleich: Open-Source, daher kostenlos nutzbar; Bereitstellungskosten hängen von der Infrastruktur ab, aber es fallen keine Lizenzgebühren an.

Qwen3 VL Series

- Was es anders macht: Die vorherige Generation der Qwen-Modelle, mit geringerer multimodaler Leistung, war in erster Linie für Text- und einfache Bildaufgaben konzipiert, ohne erweiterte Kontextfenster oder visuelle agentische Fähigkeiten.

- Preisvergleich: Open-Source, ein ähnliches frei nutzbares Modell, aber potenziell weniger leistungsfähig bei multimodalen Aufgaben als die Small-Serie.

- Wählen Sie dies, wenn... Sie mit weniger fortschrittlichen multimodalen Funktionen zurechtkommen und ein leichtgewichtiges Modell für grundlegende Text-/Bildaufgaben wünschen.

- Bleiben Sie bei Qwen3.5 Small, falls... Sie benötigen hochmoderne multimodale Fähigkeiten und längere Kontextverarbeitung.

OpenAI GPT-OSS 120B

- Was es anders macht: Dies ist ein deutlich größeres, cloud-basiertes Modell, das erstklassige Schlussfolgerungsfähigkeiten und Sprachverständnis bietet, aber erhebliche Hardware- oder Cloud-Zugänge erfordert.

- Preisvergleich: Kostenpflichtige API-Nutzung, oft teuer, insbesondere bei Aufgaben mit hohem Volumen; im Vergleich zu kostenlosen oder Open-Source-Modellen ist es teurer, aber sehr leistungsfähig.

- Wählen Sie dies, wenn... Sie das absolut beste Schlussfolgerungsvermögen und Sprachverständnis in der Cloud benötigen und Kosten weniger wichtig sind.

- Bleiben Sie bei Qwen3.5 Small, falls... Sie Offline-Lösungen mit Fokus auf Privatsphäre bevorzugen und sich nicht auf Cloud-APIs verlassen möchten.

Fazit: Sollten Sie Qwen3.5 Small ausprobieren?

Insgesamt würde ich sagen, dass Qwen3.5 Small eine solide 7/10 ist. Es ist beeindruckend für seine Größe – es liefert nahezu Spitzenleistungen beim Schlussfolgern in einem kompakten Open-Source-Paket – und die multimodalen Funktionen sind wirklich bahnbrechend für kleine Modelle. Es ist perfekt, wenn Sie Privatsphäre, Offline-Betrieb und Mehrsprachigkeit wünschen, ohne das Budget zu sprengen. Aber beachten Sie die hohe Token-Nutzung und die standardmäßig deaktivierte Begründungsfähigkeit, die Neulinge verwirren kann.

Wenn Sie KI lokal auf einem ordentlichen Laptop oder Smartphone betreiben möchten und bereit sind, ein wenig zu tüfteln, lohnt sich das auf jeden Fall. Die Open-Source-Lizenz bedeutet, dass Sie es frei anpassen können, was einen riesigen Vorteil darstellt. Wenn Sie jedoch die absolut beste Begründungsleistung benötigen und mit Cloud-Abhängigkeit sowie höheren Kosten einverstanden sind, könnten größere Modelle wie GPT-4 oder GPT-OSS 120B besser geeignet sein.

Persönlich empfehle ich, die kostenlose Version auszuprobieren, wenn Sie neugierig sind. Ein Upgrade auf eine kostenpflichtige Konfiguration macht nur Sinn, wenn Sie schwere Arbeitslasten bewältigen oder spezifische Enterprise-Funktionen benötigen. Wenn Offline-Privatsphäre und multimodale Fähigkeiten Ihre Priorität sind, ist Qwen3.5 Small eine überzeugende Wahl. Andernfalls ziehen Sie Alternativen in Betracht, die besser zu Ihren spezifischen Bedürfnissen passen.

Kurz gesagt: Wenn Sie ein vielseitiges, Open-Source-Multimodell suchen, das auf Ihrer Hardware läuft, probieren Sie es aus. Wenn Sie auf erstklassige Begründungsfähigkeiten abzielen und die Cloud nicht scheuen, schauen Sie sich woanders um.

Häufige Fragen zu Qwen3.5 Small

- Lohnt sich Qwen3.5 Small den Preis?

- Es ist aufgrund der Open-Source-Lizenz kostenlos zum Download und zur Nutzung. Die Bereitstellungskosten hängen jedoch von Ihrer Hardware und Infrastruktur ab. Es bietet ein gutes Preis-Leistungs-Verhältnis für den Offline-Einsatz mit Fokus auf Privatsphäre.

- Gibt es eine kostenlose Version?

- Ja, die Modelle sind Open-Source und kostenlos. Für einen effizienten Betrieb können jedoch Hardware erforderlich sein, die Sie bereits besitzen, oder Cloud-Ressourcen, für die Sie bezahlen müssen.

- Wie schneidet es im Vergleich zu GPT-4 oder GPT-OSS 120B ab?

- Qwen3.5 Small bietet eine beeindruckende Begründungsfähigkeit für seine Größe und lässt sich lokal ausführen, erreicht jedoch in komplexen Aufgaben im Allgemeinen nicht die rohe Leistungsstärke größerer Cloud-Modelle wie GPT-4.

- Kann es Videoanalyse oder UI-Automatisierung durchführen?

- Ja, die multimodalen Fähigkeiten umfassen Videoanalyse und UI-Navigation, was es vielseitiger macht als die meisten kleinen Modelle.

- Ist die Begründungsfähigkeit standardmäßig aktiviert?

- Nein, Begründungsfähigkeit ist in den Small-Modellen standardmäßig deaktiviert, lässt sich aber mit etwas Konfiguration aktivieren.

- Kann ich eine Rückerstattung erhalten?

- Da es Open-Source ist, gibt es keinen Kauf- oder Rückerstattungsprozess. Sie können es frei herunterladen und damit experimentieren.